§2.2一元线性回归模型的参数估计 一、一元线性回归模型的基本假设 二、参数的普通最小二乘估计(OLS) 三、参数估计的最大或然法(ML) 四、最小二乘估计量的性质 五、参数估计量的概率分布及随机干 扰项方差的估计

§2.2 一元线性回归模型的参数估计 一、一元线性回归模型的基本假设 二、参数的普通最小二乘估计(OLS) 三、参数估计的最大或然法(ML) 四、最小二乘估计量的性质 五、参数估计量的概率分布及随机干 扰项方差的估计

单方程计量经济学模型分为两大类: 线性模型和非线性模型 •线性模型中,变量之间的关系呈线性关系 •非线性模型中,变量之间的关系呈非线性关系 一元线性回归模型:只有一个解释变量 Y,=B。+BX,+4 i=1,2.,n Y为被解释变量,X为解释变量,B与B为待估 参数,为随机干扰项

单方程计量经济学模型分为两大类: 线性模型和非线性模型 •线性模型中,变量之间的关系呈线性关系 •非线性模型中,变量之间的关系呈非线性关系 一元线性回归模型:只有一个解释变量 Yi = 0 + 1 X i + i i=1,2,.,n Y为被解释变量,X为解释变量,0与1为待估 参数, 为随机干扰项

回归分析的主要目的是要通过样本回归函 数(模型)SR尽可能准确地估计总体回归函 数(模型)PRF。 估计方法有多种,其种最广泛使用的是普通 最小二乘法(ordinary least squares,.OLS)。 为保证参数估计量具有良好的性质,通常对 模型提出若干基本假设。 注:实际这些假设与所采用的估计方法紧密 相关

回归分析的主要目的是要通过样本回归函 数(模型)SRF尽可能准确地估计总体回归函 数(模型)PRF。 估计方法有多种,其种最广泛使用的是普通 最小二乘法(ordinary least squares, OLS)。 为保证参数估计量具有良好的性质,通常对 模型提出若干基本假设。 注:实际这些假设与所采用的估计方法紧密 相关

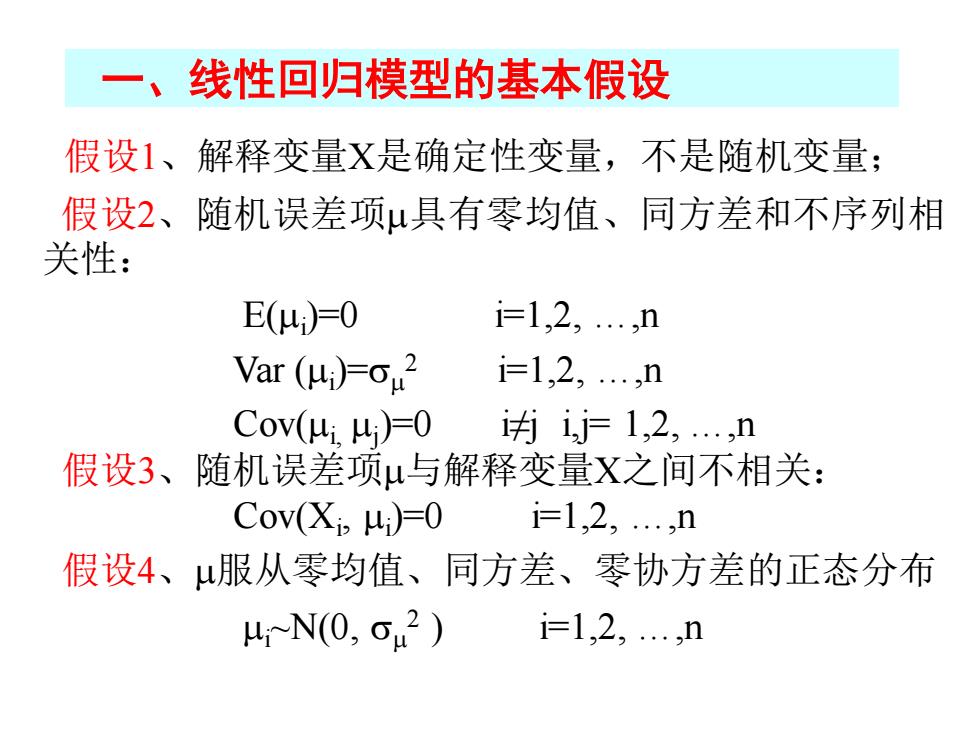

线性回归模型的基本假设 假设1、解释变量X是确定性变量,不是随机变量; 假设2、随机误差项μ具有零均值、同方差和不序列相 关性: E(4u)=0 i=1,2,.,n Var (Hi)=ou2 i=1,2,.,n CoV(4,4)=0 jijF1,2,.,n 假设3、随机误差项μ与解释变量X之间不相关: Cov(Xi,ui)-0 i=1,2,.,n 假设4、u服从零均值、同方差、零协方差的正态分布 4N(0,o2) i=1,2,.,n

一、线性回归模型的基本假设 假设1、解释变量X是确定性变量,不是随机变量; 假设2、随机误差项具有零均值、同方差和不序列相 关性: E(i )=0 i=1,2, .,n Var (i )= 2 i=1,2, .,n Cov(i, j )=0 i≠j i,j= 1,2, .,n 假设3、随机误差项与解释变量X之间不相关: Cov(Xi , i )=0 i=1,2, .,n 假设4、服从零均值、同方差、零协方差的正态分布 i~N(0, 2 ) i=1,2, .,n

注意: 1、如果假设1、2满足,则假设3也满足: 2、如果假设4满足,则假设2也满足。 以上假设也称为线性回归模型的经典假设 或高斯(Gauss)假设,满足该假设的线性回归 模型,也称为经典线性回归模型(Classical Linear Regression Model,CLRM)

1、如果假设1、2满足,则假设3也满足; 2、如果假设4满足,则假设2也满足。 注意: 以上假设也称为线性回归模型的经典假设 或高斯(Gauss)假设,满足该假设的线性回归 模型,也称为经典线性回归模型(Classical Linear Regression Model, CLRM)