模糊联想记忆 路文 2006-11-27

模糊联想记忆 路文 2006-11-27

Outline ▣言 ▣模糊lebb FAMs ▣添加FAM规则 ▣联想输出与清晰化 ▣FAM系统结构 西安电子科技大学影彩像处理系统实验室

Outline 引言 模糊 Hebb FAMs 添加FAM规则 联想输出与清晰化 FAM系统结构 西安电子科技大学影像处理系统实验室

引言 冬Hebb假设:Donald O.Hebb在《The Organization of Behavior》)一书中提 出:“当细胞A的轴突到细胞B的距离近到足够激励它,且反复地或持续 地刺激B,那么在这两个细胞或一个细胞中将会发生某种增长过程或代谢 反应,增加A对细胞B的刺激效果”。 必 1987年美国Bart Kosko教授提出了一种称为模糊联想记忆神经网络(Fuz2y Associative MemoryFAM,这种联想记忆神经网络是将模糊控制的规 则隐含地分布在整个网络中,在神经网络的基础上通过学习训练产生模糊 规测,一次模糊联想记忆就是一次模糊逻辑推理。 在模糊控制、知识推理和模式匹配等领域有着广泛的应用前景。 西安电子科技大学影彩像处理系统实验室

引言 ❖ Hebb假设 :Donald O.Hebb 在《The Organization of Behavior》一书中提 出:“当细胞A的轴突到细胞B的距离近到足够激励它,且反复地或持续 地刺激B,那么在这两个细胞或一个细胞中将会发生某种增长过程或代谢 反应,增加A对细胞B的刺激效果”。 ❖ 1987年美国Bart Kosko教授提出了一种称为模糊联想记忆神经网络(Fuzzy Associative Memory——FAM,这种联想记忆神经网络是将模糊控制的规 则隐含地分布在整个网络中,在神经网络的基础上通过学习训练产生模糊 规则,一次模糊联想记忆就是一次模糊逻辑推理。 ❖ 在模糊控制、知识推理和模式匹配等领域有着广泛的应用前景。 西安电子科技大学影像处理系统实验室

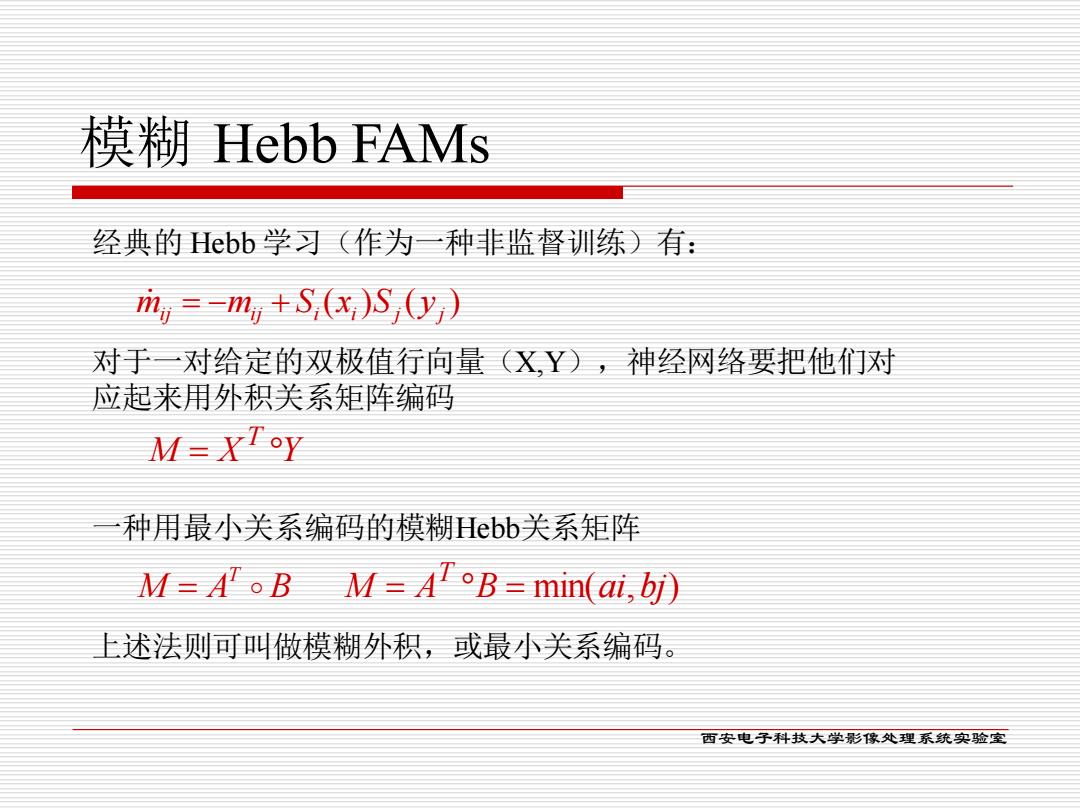

模糊Hebb FAMs 经典的Hebb学习(作为一种非监督训练)有 m,==m,+S(x)S(y写) 对于一对给定的双极值行向量(X,Y),神经网络要把他们对 应起来用外积关系矩阵编码 M=XToY 种用最小关系编码的模糊Hebb关系矩阵 M=AT o B M=AB=min(ai,bi) 上述法则可叫做模糊外积,或最小关系编码。 西安电子科技大学影彩像处理系统实验室

模糊 Hebb FAMs M X Y T = ( ) ( ) ij ij i i j j m = −m + S x S y M A B min(ai,bj) T = = 经典的 Hebb 学习(作为一种非监督训练)有: 对于一对给定的双极值行向量(X,Y),神经网络要把他们对 应起来用外积关系矩阵编码 西安电子科技大学影像处理系统实验室 一种用最小关系编码的模糊Hebb关系矩阵 M A B T = 上述法则可叫做模糊外积,或最小关系编码

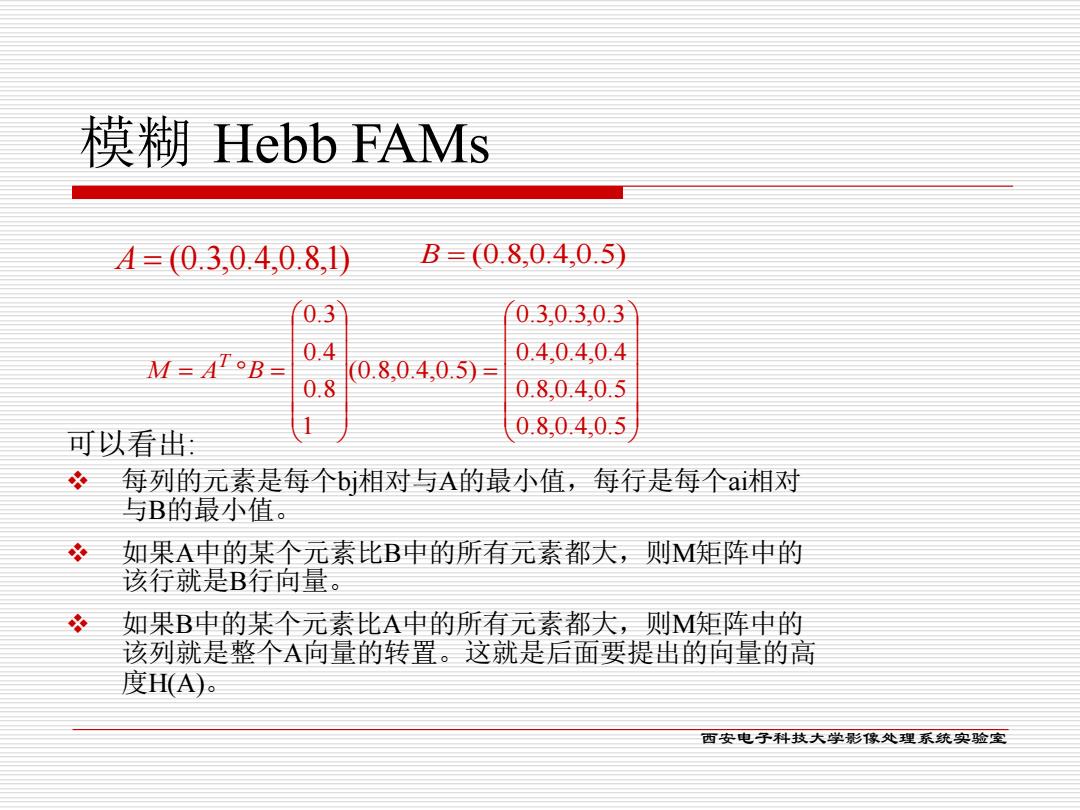

模糊Hebb FAMs A=(0.3,0.4,0.8,1 B=(0.8,0.4,0.5) 0.3 0.3,0.3,0.3 M=ATB= 0.4 0.4,0.40.4 0.8,0.4,0.5)= 0.8 0.8,0.40.5 0.8,0.4,0.5 可以看出: 必 每列的元素是每个bj相对与A的最小值,每行是每个ai相对 与B的最小值。 水 如果A中的某个元素比B中的所有元素都大,则M矩阵中的 该行就是B行向量。 必 如果B中的某个元素比A中的所有元素都大,则M矩阵中的 该列就是整个A向量的转置。这就是后面要提出的向量的高 度H(A)。 西安电子科技大学影彩像处理系统实验室

模糊 Hebb FAMs 可以看出: ❖ 每列的元素是每个bj相对与A的最小值,每行是每个ai相对 与B的最小值。 ❖ 如果A中的某个元素比B中的所有元素都大,则M矩阵中的 该行就是B行向量。 ❖ 如果B中的某个元素比A中的所有元素都大,则M矩阵中的 该列就是整个A向量的转置。这就是后面要提出的向量的高 度H(A)。 A = (0.3,0.4,0.8,1) B = (0.8,0.4,0.5) = = = 0.8,0.4,0.5 0.8,0.4,0.5 0.4,0.4,0.4 0.3,0.3,0.3 (0.8,0.4,0.5) 1 0.8 0.4 0.3 M A B T 西安电子科技大学影像处理系统实验室