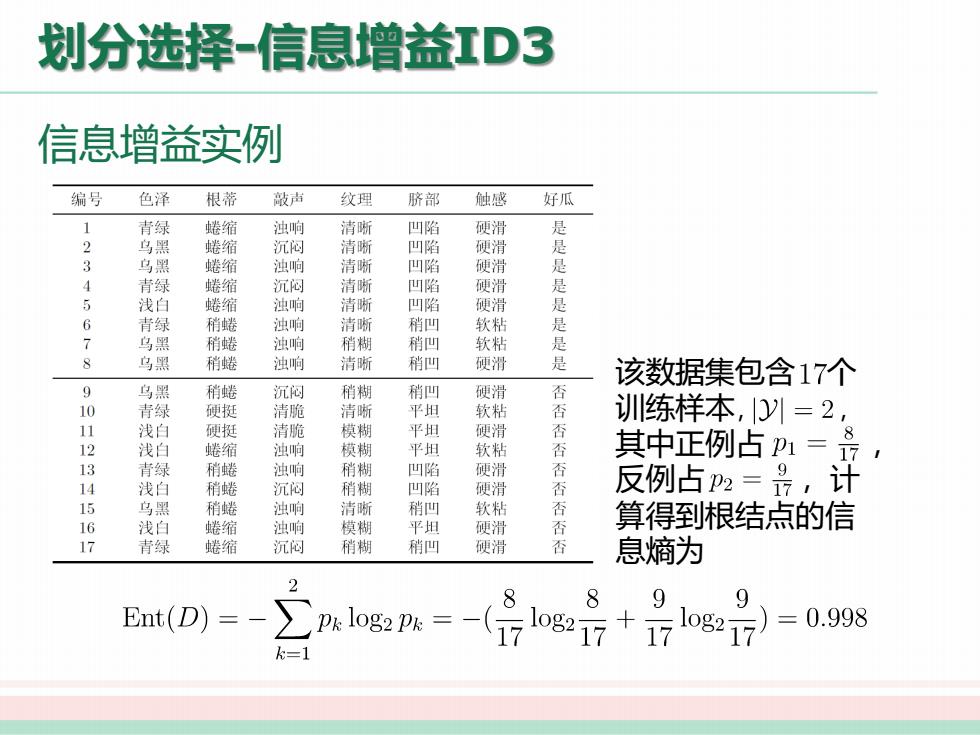

划分选择-信息增益ID3 信息增益实例 编号 色泽 根蒂 敲声 纹理 脐部 触感 好瓜 青绿 蜷缩 浊响 清晰 凹陷 硬滑 乌黑 蜷缩 沉闷 清晰 凹陷 硬滑 乌黑 蜷缩 浊响 清晰 硬滑 青绿 蜷缩 沉闷 清 陷 硬滑 浅白 蜷缩 浊响 清晰 凹 硬滑 6 青绿 稍蜷 浊响 清晰 凹 软精 是是是是是是 乌黑 稍蜷 浊响 稍糊 稍凹 软粘 8 乌黑 稍蜷 浊响 清晰 稍凹 硬滑 该数据集包含17个 9 稍蜷 沉闷 稍糊 稍凹 硬滑 10 青绿 硬挺 清脆 清晰 平坦 软粘 112 浅 硬挺 清脆 模糊 细 硬滑 香香 训练样本,1门y川=2, 浅白 蜷缩 浊响 模糊 软粘 其中正例占p1= 3 青绿 稍蜷 浊响 稍糊 凹陷 硬滑 浅白 稍蜷 沉闷 稍糊 凹陷 硬滑 行 反例占2=品,计 15 乌黑 稍蜷 浊响 清晰 稍凹 软粘 1 浅白 蜷缩 浊响 模糊 平坦 硬滑 算得到根结点的信 17 青 蜷缩 沉闷 稍糊 稍凹 硬滑 否 息熵为 2 9 Ent(D) (7108217+171o8217 =0.998 k=1

划分选择-信息增益ID3 信息增益实例 …... … …... … 该数据集包含 个 训练样本, , 其中正例占 , 反例占 ,计 算得到根结点的信 息熵为

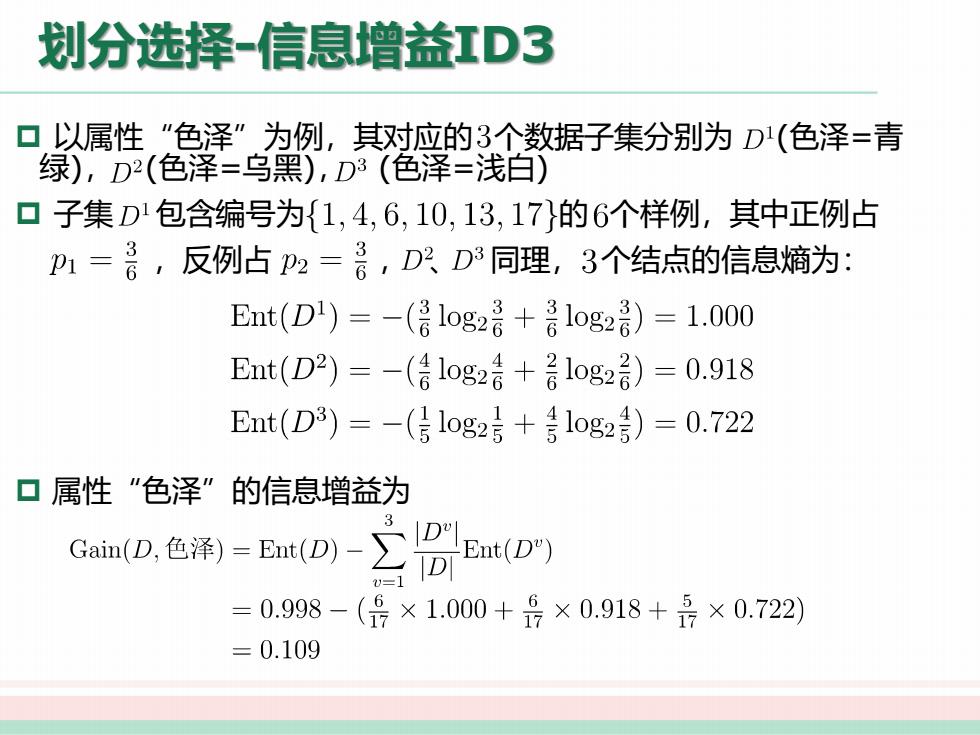

划分选择-信息增益缸D3 口以属性“色泽”为例,其对应的3个数据子集分别为D(色泽=青 绿),D2(色泽=乌黑),D3(色泽=浅白) 口子集D1包含编号为{1,4,6,10,13,17}的6个样例,其中正例占 p1=各,反例占2=音,DD3同理,3个结点的信息熵为: Ent(D)=-(log2+log2)=1.000 Ent(D2)=-(詹1og2着+1og2)=0.918 Dmt(D3)=-(号log2号+号1og2)=0.722 口属性"色泽”的信息增益为 Gain(D,色泽)=Ent(D)-】 D'Et(D) =0.998- (9×1.000+号×0.918+号×0.722 =0.109

划分选择-信息增益ID3 p 以属性“色泽”为例,其对应的 个数据子集分别为 (色泽=青 绿), (色泽=乌黑), (色泽=浅白) p 子集 包含编号为 的 个样例,其中正例占 ,反例占 , 、 同理, 个结点的信息熵为: p 属性“色泽”的信息增益为

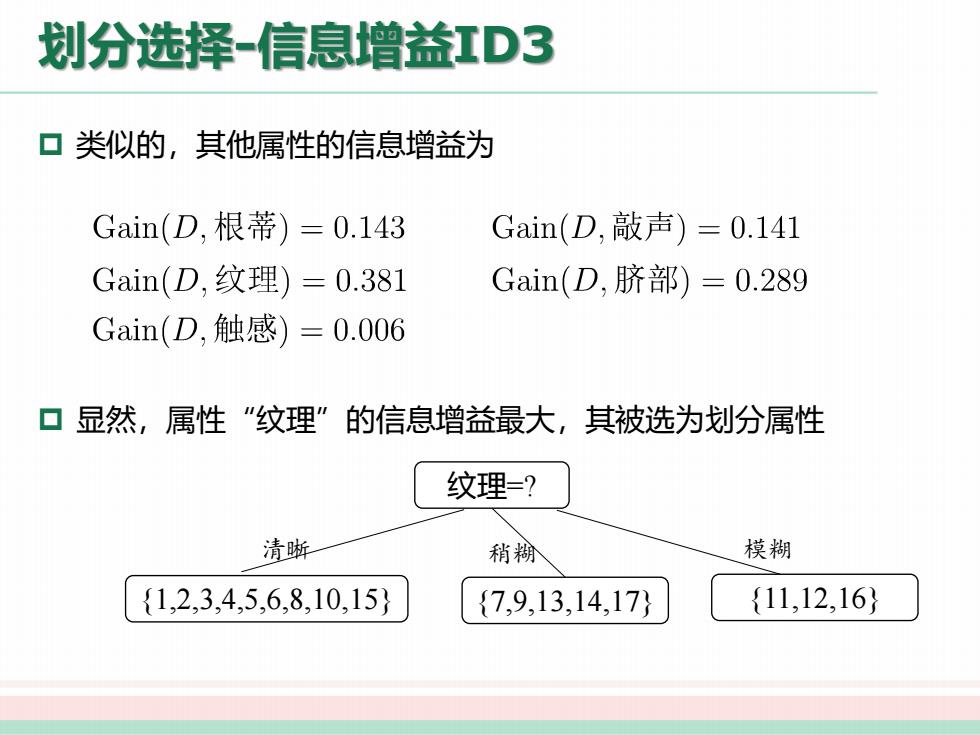

划分选择-信息增益红D3 口类似的,其他属性的信息增益为 Gain(D,根蒂)=0.143 Gain(D,敲声)=0.141 Gain(D,纹理)=0.381 Gain(D,脐部)=0.289 Gain(D,触感)=0.006 口显然,属性“纹理”的信息增益最大,其被选为划分属性 纹理=? 清晰 稍糊 模糊 {1,2,3,4,5,6,8,10,15} {7,9,13,14,17} {11,12,16}

划分选择-信息增益ID3 p 类似的,其他属性的信息增益为 p 显然,属性“纹理”的信息增益最大,其被选为划分属性 清晰 稍糊 模糊 {1,2,3,4,5,6,8,10,15} 纹理=? {7,9,13,14,17} {11,12,16}

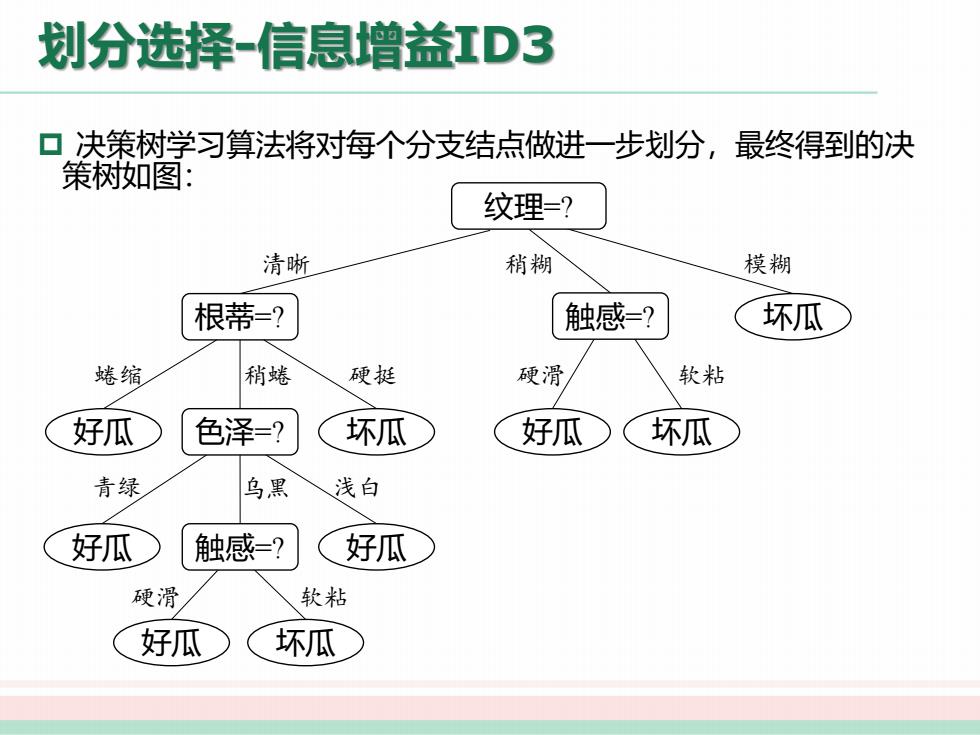

划分选择-信息增益缸D3 口决策树学习算法将对每个分支结点做进一步划分,最终得到的决 策树如图: 纹理=? 清晰 稍糊 模糊 根蒂=? 触感-? 坏瓜 蜷缩 稍蜷 硬挺 硬滑 软粘 好瓜 色泽=? 坏瓜 好瓜 坏瓜 青绿 乌黑 浅白 好瓜 触感=? 好瓜 硬滑 软粘 好瓜 坏瓜

划分选择-信息增益ID3 p 决策树学习算法将对每个分支结点做进一步划分,最终得到的决 策树如图: 清晰 稍糊 模糊 根蒂=? 坏瓜 纹理=? 好瓜 坏瓜 蜷缩 稍蜷 硬挺 好瓜 坏瓜 好瓜 好瓜 色泽=? 青绿 乌黑 浅白 好瓜 坏瓜 触感=? 硬滑 软粘 触感=? 硬滑 软粘

划分选择-信息增益缸D3 存在的问题 口若把”编号”也作为一个候选划分属性,则其信息增益一般远大 于其他属性。显然,这样的决策树不具有泛化能力,无法对新样本 进行有效预测 信息增益对可取值数目较多的属性有所偏好

划分选择-信息增益ID3 存在的问题 p 若把“编号”也作为一个候选划分属性,则其信息增益一般远大 于其他属性。显然,这样的决策树不具有泛化能力,无法对新样本 进行有效预测 信息增益对可取值数目较多的属性有所偏好