第11卷第6期 智能系统学报 Vol.11 No.6 2016年12月 CAAI Transactions on Intelligent Systems Dec.2016 D0I:10.11992/is.201612015 网络出版地址:http://www.cnki.net/kcms/detail,/23.1538.TP.20170111.1705.028.html 随机权神经网络研究现状与展望 乔俊飞13,李凡军2,杨翠丽13 (1.北京工业大学信息学部,北京100124;2.济南大学数学科学学院,山东济南250022;3.计算智能与智能系统北 京市重点实验室,北京100124) 摘要:神经网络随机学习克服了传统梯度类算法所固有的收敛速度慢及局部极小问题,最近已成为神经网络领域 的研究热点之一。基于随机学习的思想,人们设计了不同结构的随机权神经网络模型。本文旨在回顾总结随机权 神经网络的研究现状基础上,给出其发展趋势。首先,提出随机权神经网络简化模型,并基于简化模型给出神经网 络随机学习算法:其次,回顾总结随机权神经网络研究现状,基于简化模型分析不同结构随机权神经网络的性能及 随机权初始化方法:最后,给出随机权神经网络今后的发展趋势。 关键词:随机权神经网络:前馈神经网络:递归神经网络:级联神经网络:随机学习算法 中图分类号:TP183文献标志码:A文章编号:1673-4785(2016)06-0758-10 中文引用格式:乔俊飞,李凡军,杨翠丽.随机权神经网络研究现状与展望[J].智能系统学报,2016,11(6):758-767. 英文引用格式:QIAO Junfei,LI Fanjun,YANG Cuili..Review and prospect on neural networks with random weights[J].CAAl Transactions on Intelligent Systems,2016,11(6):758-767. Review and prospect on neural networks with random weights QIAO Junfei3,LI Fanjun2,YANG Cuili3 (1.Faculty of Information Technology,Beijing University of Technology,Beijing 100124,China;2.School of Mathematical Science, University of Jinan,Jinan 250022,China;3.Beijing Key Laboratory of Computational Intelligence and Intelligent System,Beijing 100124,China) Abstract:A randomized learning algorithm in a neural network,which can overcome the difficulty of slow conver- gence and local minimum inherently in the traditional gradient-based learning algorithms,has recently become a hot topic in the field of neural networks.Some neural networks with random weights using randomized learning algo- rithms have been proposed.The aim of this paper summarizes the current research on neural networks with random weights and provides some views about its development trends.First,a simplified model of a neural network with random weights was proposed,and the randomized learning algorithm was summarized,based on the simplified model.Then,a review on neural networks with random weights was given,and the performance of several different neural networks with random weights was analyzed,based on the simplified model.Finally,several views on neural networks with random weights are presented. Keywords:neural network with random weights;feedforward neural network;recurrent neural network;cascade neural network:randomized learning algorithm 人工神经网络是通过模仿大脑神经系统的组织 收稿日期:2016-12-12. 结构及活动机理进行信息处理的新型网络系统,具 基金项目:国家自然科学基金项目(61533002,61603012):北京市自然 科学基金项目(Z141100001414005):北京市教委基金项目 有从环境中学习的能力,并引起诸多领域的广泛关 (km201410005001,KZ201410005002). 注,比如信号处理、智能控制、模式识别、图像处理、 通信作者:乔俊飞.E-mail:junfeiq@bjut.cdu.cn. 非线性系统建模与优化、大数据处理、知识处理等领

第 11 卷第 6 期 智 能 系 统 学 报 Vol.11 №.6 2016 年 12 月 CAAI Transactions on Intelligent Systems Dec. 2016 DOI:10.11992 / tis.201612015 网络出版地址:http: / / www.cnki.net / kcms/ detail / 23.1538.TP.20170111.1705.028.html 随机权神经网络研究现状与展望 乔俊飞1,3 ,李凡军2 ,杨翠丽1,3 (1.北京工业大学 信息学部,北京 100124; 2.济南大学 数学科学学院,山东 济南 250022; 3.计算智能与智能系统北 京市重点实验室,北京 100124) 摘 要:神经网络随机学习克服了传统梯度类算法所固有的收敛速度慢及局部极小问题,最近已成为神经网络领域 的研究热点之一。 基于随机学习的思想,人们设计了不同结构的随机权神经网络模型。 本文旨在回顾总结随机权 神经网络的研究现状基础上,给出其发展趋势。 首先,提出随机权神经网络简化模型,并基于简化模型给出神经网 络随机学习算法;其次,回顾总结随机权神经网络研究现状,基于简化模型分析不同结构随机权神经网络的性能及 随机权初始化方法;最后,给出随机权神经网络今后的发展趋势。 关键词:随机权神经网络;前馈神经网络;递归神经网络;级联神经网络;随机学习算法 中图分类号: TP183 文献标志码:A 文章编号:1673-4785(2016)06-0758-10 中文引用格式:乔俊飞,李凡军,杨翠丽. 随机权神经网络研究现状与展望[J]. 智能系统学报, 2016, 11(6): 758-767. 英文引用格式:QIAO Junfei, LI Fanjun, YANG Cuili. Review and prospect on neural networks with random weights[ J]. CAAI Transactions on Intelligent Systems, 2016, 11(6): 758-767. Review and prospect on neural networks with random weights QIAO Junfei 1,3 , LI Fanjun 2 , YANG Cuili 1,3 (1.Faculty of Information Technology, Beijing University of Technology, Beijing 100124, China; 2.School of Mathematical Science, University of Jinan, Jinan 250022, China; 3. Beijing Key Laboratory of Computational Intelligence and Intelligent System, Beijing 100124, China) Abstract:A randomized learning algorithm in a neural network, which can overcome the difficulty of slow conver⁃ gence and local minimum inherently in the traditional gradient⁃based learning algorithms, has recently become a hot topic in the field of neural networks. Some neural networks with random weights using randomized learning algo⁃ rithms have been proposed. The aim of this paper summarizes the current research on neural networks with random weights and provides some views about its development trends. First, a simplified model of a neural network with random weights was proposed, and the randomized learning algorithm was summarized, based on the simplified model. Then, a review on neural networks with random weights was given, and the performance of several different neural networks with random weights was analyzed, based on the simplified model. Finally, several views on neural networks with random weights are presented. Keywords: neural network with random weights; feedforward neural network; recurrent neural network; cascade neural network; randomized learning algorithm 收稿日期:2016-12-12. 基金项目:国家自然科学基金项目( 61533002,61603012);北京市自然 科学基金项目( Z141100001414005);北京市教委基金项目 (km201410005001,KZ201410005002). 通信作者:乔俊飞. E⁃mail:junfeiq@ bjut.edu.cn. 人工神经网络是通过模仿大脑神经系统的组织 结构及活动机理进行信息处理的新型网络系统,具 有从环境中学习的能力,并引起诸多领域的广泛关 注,比如信号处理、智能控制、模式识别、图像处理、 非线性系统建模与优化、大数据处理、知识处理等领

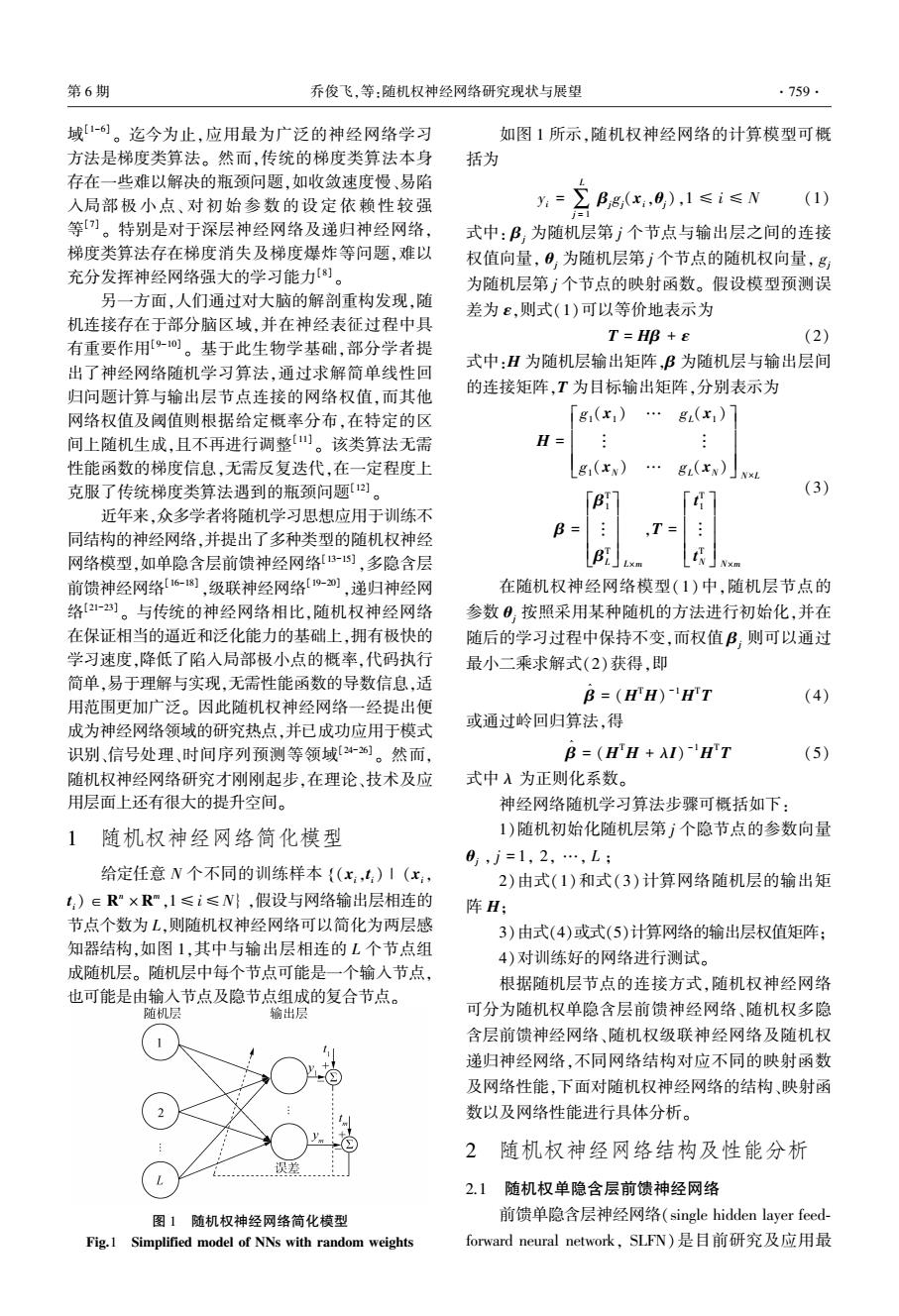

第6期 乔俊飞,等:随机权神经网络研究现状与展望 .759. 域1-。迄今为止,应用最为广泛的神经网络学习 如图1所示,随机权神经网络的计算模型可概 方法是梯度类算法。然而,传统的梯度类算法本身 括为 存在一些难以解决的瓶颈问题,如收敛速度慢、易陷 入局部极小点、对初始参数的设定依赖性较强 := ∑B,g(x,0,),1≤i≤N (1) 等[)。特别是对于深层神经网络及递归神经网络, 式中:B,为随机层第j个节点与输出层之间的连接 梯度类算法存在梯度消失及梯度爆炸等问题,难以 权值向量,0,为随机层第j个节点的随机权向量, 充分发挥神经网络强大的学习能力]。 为随机层第广个节点的映射函数。假设模型预测误 另一方面,人们通过对大脑的解剖重构发现,随 差为ε,则式(1)可以等价地表示为 机连接存在于部分脑区域,并在神经表征过程中具 有重要作用9-0]。基于此生物学基础,部分学者提 T=H邱+e (2) 式中:H为随机层输出矩阵,β为随机层与输出层间 出了神经网络随机学习算法,通过求解简单线性回 归问题计算与输出层节点连接的网络权值,而其他 的连接矩阵,T为目标输出矩阵,分别表示为 网络权值及阈值则根据给定概率分布,在特定的区 81(x1)…g(x1) 间上随机生成,且不再进行调整)。该类算法无需 H= 性能函数的梯度信息,无需反复迭代,在一定程度上 8(XN) g(xw)Jx 克服了传统梯度类算法遇到的瓶颈问题2]。 (3) 近年来,众多学者将随机学习思想应用于训练不 同结构的神经网络,并提出了多种类型的随机权神经 B 网络模型,如单隐含层前馈神经网络3-),多隐含层 B t Nxm 前馈神经网络16-1】,级联神经网络90),递归神经网 在随机权神经网络模型(1)中,随机层节点的 络[2-2)]。与传统的神经网络相比,随机权神经网络 参数0,按照采用某种随机的方法进行初始化,并在 在保证相当的逼近和泛化能力的基础上,拥有极快的 随后的学习过程中保持不变,而权值B:则可以通过 学习速度,降低了陷入局部极小点的概率,代码执行 最小二乘求解式(2)获得,即 简单,易于理解与实现,无需性能函数的导数信息,适 用范围更加广泛。因此随机权神经网络一经提出便 B=(HH)HT (4) 成为神经网络领域的研究热点,并已成功应用于模式 或通过岭回归算法,得 识别、信号处理、时间序列预测等领域24。然而, B=(HH+AIHT (5) 随机权神经网络研究才刚刚起步,在理论、技术及应 式中入为正则化系数。 用层面上还有很大的提升空间。 神经网络随机学习算法步骤可概括如下: 1 随机权神经网络简化模型 1)随机初始化随机层第广个隐节点的参数向量 0,j=1,2,…,L; 给定任意N个不同的训练样本{(x:,:)I(x, 2)由式(1)和式(3)计算网络随机层的输出矩 t:)∈R”×R,1≤i≤N},假设与网络输出层相连的 阵H; 节点个数为L,则随机权神经网络可以简化为两层感 3)由式(4)或式(5)计算网络的输出层权值矩阵: 知器结构,如图1,其中与输出层相连的L个节点组 4)对训练好的网络进行测试。 成随机层。随机层中每个节点可能是一个输入节点, 根据随机层节点的连接方式,随机权神经网络 也可能是由输入节点及隐节点组成的复合节点。 随机层 输出层 可分为随机权单隐含层前馈神经网络、随机权多隐 含层前馈神经网络、随机权级联神经网络及随机权 递归神经网络,不同网络结构对应不同的映射函数 及网络性能,下面对随机权神经网络的结构、映射函 数以及网络性能进行具体分析。 2随机权神经网络结构及性能分析 2.1随机权单隐含层前馈神经网络 图1随机权神经网络简化模型 前馈单隐含层神经网络(single hidden layer feed- Fig.1 Simplified model of NNs with random weights forward neural network,SLFN)是目前研究及应用最

域[1-6] 。 迄今为止,应用最为广泛的神经网络学习 方法是梯度类算法。 然而,传统的梯度类算法本身 存在一些难以解决的瓶颈问题,如收敛速度慢、易陷 入局部 极 小 点、 对 初 始 参 数 的 设 定 依 赖 性 较 强 等[7] 。 特别是对于深层神经网络及递归神经网络, 梯度类算法存在梯度消失及梯度爆炸等问题,难以 充分发挥神经网络强大的学习能力[8] 。 另一方面,人们通过对大脑的解剖重构发现,随 机连接存在于部分脑区域,并在神经表征过程中具 有重要作用[9-10] 。 基于此生物学基础,部分学者提 出了神经网络随机学习算法,通过求解简单线性回 归问题计算与输出层节点连接的网络权值,而其他 网络权值及阈值则根据给定概率分布,在特定的区 间上随机生成,且不再进行调整[11] 。 该类算法无需 性能函数的梯度信息,无需反复迭代,在一定程度上 克服了传统梯度类算法遇到的瓶颈问题[12] 。 近年来,众多学者将随机学习思想应用于训练不 同结构的神经网络,并提出了多种类型的随机权神经 网络模型,如单隐含层前馈神经网络[13-15] ,多隐含层 前馈神经网络[16-18] ,级联神经网络[19-20] ,递归神经网 络[21-23] 。 与传统的神经网络相比,随机权神经网络 在保证相当的逼近和泛化能力的基础上,拥有极快的 学习速度,降低了陷入局部极小点的概率,代码执行 简单,易于理解与实现,无需性能函数的导数信息,适 用范围更加广泛。 因此随机权神经网络一经提出便 成为神经网络领域的研究热点,并已成功应用于模式 识别、信号处理、时间序列预测等领域[24-26] 。 然而, 随机权神经网络研究才刚刚起步,在理论、技术及应 用层面上还有很大的提升空间。 1 随机权神经网络简化模型 给定任意 N 个不同的训练样本 (xi { ,t i) | (xi, t i) ∈R n × R m ,1≤i≤N} ,假设与网络输出层相连的 节点个数为 L,则随机权神经网络可以简化为两层感 知器结构,如图 1,其中与输出层相连的 L 个节点组 成随机层。 随机层中每个节点可能是一个输入节点, 也可能是由输入节点及隐节点组成的复合节点。 图 1 随机权神经网络简化模型 Fig.1 Simplified model of NNs with random weights 如图 1 所示,随机权神经网络的计算模型可概 括为 yi = ∑ L j = 1 βjgj(xi,θj),1 ≤ i ≤ N (1) 式中: βj 为随机层第 j 个节点与输出层之间的连接 权值向量, θj 为随机层第 j 个节点的随机权向量, gj 为随机层第 j 个节点的映射函数。 假设模型预测误 差为 ε,则式(1)可以等价地表示为 T = Hβ + ε (2) 式中:H 为随机层输出矩阵,β 为随机层与输出层间 的连接矩阵,T 为目标输出矩阵,分别表示为 H = g1(x1 ) … gL(x1 ) ︙ ︙ g1(xN) … gL(xN) é ë ê ê ê ê ù û ú ú ú ú N×L β = β T 1 ︙ β T L é ë ê ê ê ê ù û ú ú ú ú L×m ,T = t T 1 ︙ t T N é ë ê ê ê ê ù û ú ú ú ú N×m (3) 在随机权神经网络模型(1)中,随机层节点的 参数 θj 按照采用某种随机的方法进行初始化,并在 随后的学习过程中保持不变,而权值 βj 则可以通过 最小二乘求解式(2)获得,即 β ^ = (H TH) -1H TT (4) 或通过岭回归算法,得 β ^ = (H TH + λI) -1H TT (5) 式中 λ 为正则化系数。 神经网络随机学习算法步骤可概括如下: 1)随机初始化随机层第 j 个隐节点的参数向量 θj , j = 1, 2, …, L ; 2)由式(1)和式(3)计算网络随机层的输出矩 阵 H; 3)由式(4)或式(5)计算网络的输出层权值矩阵; 4)对训练好的网络进行测试。 根据随机层节点的连接方式,随机权神经网络 可分为随机权单隐含层前馈神经网络、随机权多隐 含层前馈神经网络、随机权级联神经网络及随机权 递归神经网络,不同网络结构对应不同的映射函数 及网络性能,下面对随机权神经网络的结构、映射函 数以及网络性能进行具体分析。 2 随机权神经网络结构及性能分析 2.1 随机权单隐含层前馈神经网络 前馈单隐含层神经网络(single hidden layer feed⁃ forward neural network, SLFN)是目前研究及应用最 第 6 期 乔俊飞,等:随机权神经网络研究现状与展望 ·759·

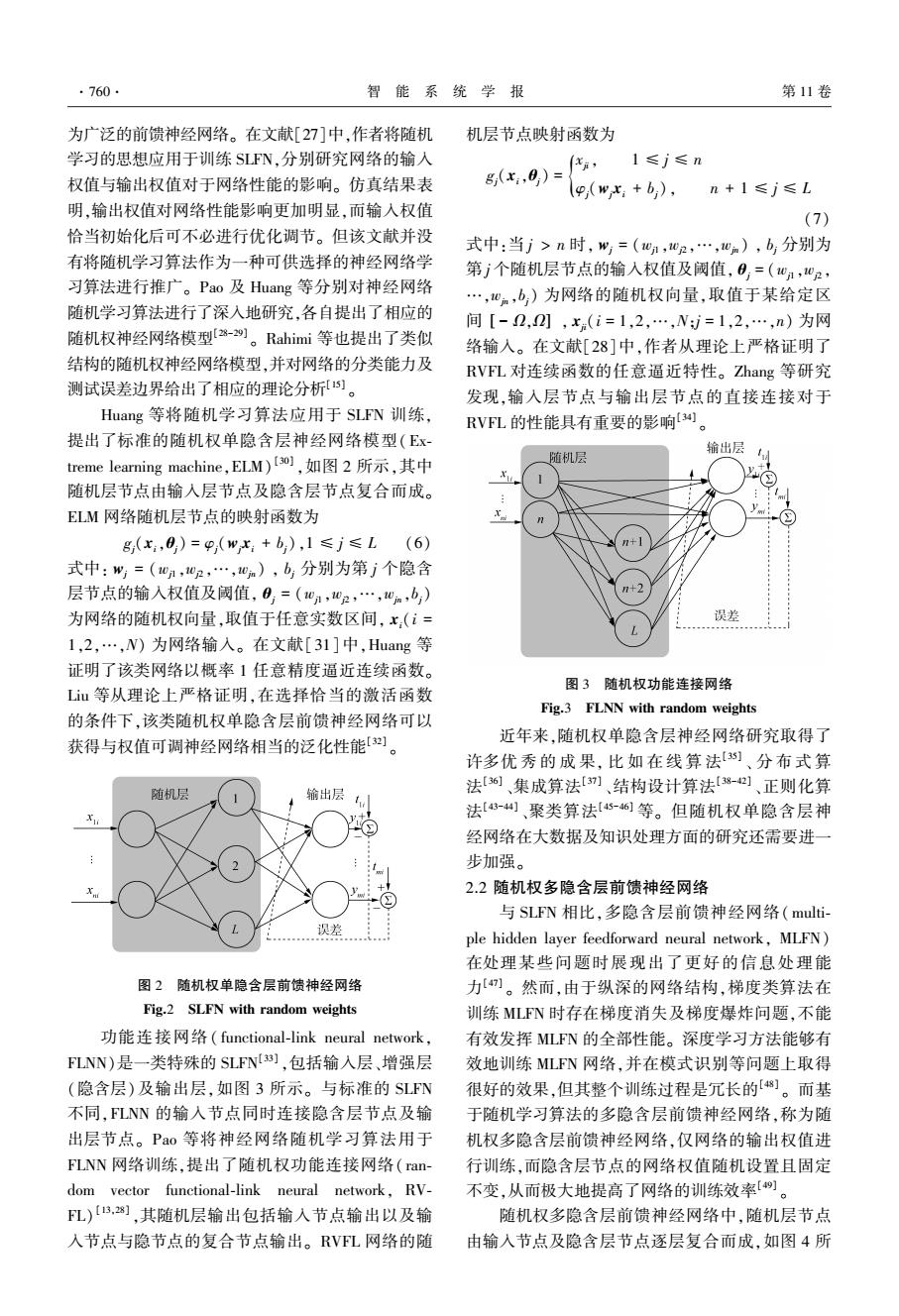

.760 智能系统学报 第11卷 为广泛的前馈神经网络。在文献[27]中,作者将随机 机层节点映射函数为 学习的思想应用于训练SLFN,分别研究网络的输入 (元, 1≤j≤n 权值与输出权值对于网络性能的影响。仿真结果表 8(x:,0)= (9(wx:+b), n+1≤j≤L 明,输出权值对网络性能影响更加明显,而输入权值 (7) 恰当初始化后可不必进行优化调节。但该文献并没 式中:当j>n时,w,=(01,02,…,四m),b分别为 有将随机学习算法作为一种可供选择的神经网络学 第j个随机层节点的输入权值及阈值,0=(w1,02, 习算法进行推广。Pao及Huang等分别对神经网络 …,心m,b)为网络的随机权向量,取值于某给定区 随机学习算法进行了深入地研究,各自提出了相应的 间[-2,2],x(i=1,2,…,Ni=1,2,…,n)为网 随机权神经网络模型2-)。Rahimi等也提出了类似 络输入。在文献[28]中,作者从理论上严格证明了 结构的随机权神经网络模型,并对网络的分类能力及 RVFL对连续函数的任意逼近特性。Zhang等研究 测试误差边界给出了相应的理论分析5)。 发现,输入层节点与输出层节点的直接连接对于 Huang等将随机学习算法应用于SLFN训练, RVFL的性能具有重要的影响。 提出了标准的随机权单隐含层神经网络模型(Ex 输出层t treme learning machine,ELM)[so),如图2所示,其中 随机层 随机层节点由输入层节点及隐含层节点复合而成。 ELM网络随机层节点的映射函数为 8(x:,8)=9(wx:+b),1≤j≤L(6) 式中:州,=(01,02,…,0n),6分别为第j个隐含 层节点的输入权值及阈值,0,=(01,02,…,0m,b) 为网络的随机权向量,取值于任意实数区间,x,(i= 误差 1,2,…,N)为网络输入。在文献[31]中,Huang等 证明了该类网络以概率1任意精度逼近连续函数。 图3随机权功能连接网络 Li山等从理论上严格证明,在选择恰当的激活函数 Fig.3 FLNN with random weights 的条件下,该类随机权单隐含层前馈神经网络可以 获得与权值可调神经网络相当的泛化性能划。 近年来,随机权单隐含层神经网络研究取得了 许多优秀的成果,比如在线算法3]、分布式算 随机层 输出层 法[36]、集成算法[3刃、结构设计算法[3-]、正则化算 法[48-4]、聚类算法[45-6]等。但随机权单隐含层神 经网络在大数据及知识处理方面的研究还需要进一 步加强。 2.2随机权多隐含层前馈神经网络 与SLFN相比,多隐含层前馈神经网络(muli- 误差 ple hidden layer feedforward neural network,MLFN) 在处理某些问题时展现出了更好的信息处理能 图2随机权单隐含层前馈神经网络 力[。然而,由于纵深的网络结构,梯度类算法在 Fig.2 SLFN with random weights 训练MLN时存在梯度消失及梯度爆炸问题,不能 功能连接网络(functional-link neural network, 有效发挥MLFN的全部性能。深度学习方法能够有 FLNN)是一类特殊的SLFN3)],包括输入层、增强层 效地训练MLFN网络,并在模式识别等问题上取得 (隐含层)及输出层,如图3所示。与标准的SLFN 很好的效果,但其整个训练过程是冗长的]。而基 不同,FLNN的输入节点同时连接隐含层节点及输 于随机学习算法的多隐含层前馈神经网络,称为随 出层节点。Pao等将神经网络随机学习算法用于 机权多隐含层前馈神经网络,仅网络的输出权值进 FLNN网络训练,提出了随机权功能连接网络(ran- 行训练,而隐含层节点的网络权值随机设置且固定 dom vector functional-link neural network,RV- 不变,从而极大地提高了网络的训练效率[49。 ℉L)【B,2],其随机层输出包括输入节点输出以及输 随机权多隐含层前馈神经网络中,随机层节点 入节点与隐节点的复合节点输出。RVFL网络的随 由输入节点及隐含层节点逐层复合而成,如图4所

为广泛的前馈神经网络。 在文献[27]中,作者将随机 学习的思想应用于训练 SLFN,分别研究网络的输入 权值与输出权值对于网络性能的影响。 仿真结果表 明,输出权值对网络性能影响更加明显,而输入权值 恰当初始化后可不必进行优化调节。 但该文献并没 有将随机学习算法作为一种可供选择的神经网络学 习算法进行推广。 Pao 及 Huang 等分别对神经网络 随机学习算法进行了深入地研究,各自提出了相应的 随机权神经网络模型[28-29] 。 Rahimi 等也提出了类似 结构的随机权神经网络模型,并对网络的分类能力及 测试误差边界给出了相应的理论分析[15] 。 Huang 等将随机学习算法应用于 SLFN 训练, 提出了标准的随机权单隐含层神经网络模型(Ex⁃ treme learning machine,ELM) [30] ,如图 2 所示,其中 随机层节点由输入层节点及隐含层节点复合而成。 ELM 网络随机层节点的映射函数为 gj(xi,θj) = φj(wjxi + bj),1 ≤ j ≤ L (6) 式中: wj = (wj1 ,wj2 ,…,wjn ) , bj 分别为第 j 个隐含 层节点的输入权值及阈值, θj = (wj1 ,wj2 ,…,wjn ,bj) 为网络的随机权向量,取值于任意实数区间, xi(i = 1,2,…,N) 为网络输入。 在文献[31]中,Huang 等 证明了该类网络以概率 1 任意精度逼近连续函数。 Liu 等从理论上严格证明,在选择恰当的激活函数 的条件下,该类随机权单隐含层前馈神经网络可以 获得与权值可调神经网络相当的泛化性能[32] 。 图 2 随机权单隐含层前馈神经网络 Fig.2 SLFN with random weights 功能连接网络( functional⁃link neural network, FLNN)是一类特殊的 SLFN [33] ,包括输入层、增强层 (隐含层)及输出层,如图 3 所示。 与标准的 SLFN 不同,FLNN 的输入节点同时连接隐含层节点及输 出层节点。 Pao 等将神经网络随机学习算法用于 FLNN 网络训练,提出了随机权功能连接网络( ran⁃ dom vector functional⁃link neural network, RV⁃ FL) [13,28] ,其随机层输出包括输入节点输出以及输 入节点与隐节点的复合节点输出。 RVFL 网络的随 机层节点映射函数为 gj(xi,θj) = xji, 1 ≤ j ≤ n φj(wjxi + b { j), n + 1 ≤ j ≤ L (7) 式中:当 j > n 时, wj = (wj1 ,wj2 ,…,wjn ) , bj 分别为 第 j 个随机层节点的输入权值及阈值, θj = (wj1 ,wj2 , …,wjn ,bj) 为网络的随机权向量,取值于某给定区 间 [ - Ω,Ω] , xji(i = 1,2,…,N;j = 1,2,…,n) 为网 络输入。 在文献[28]中,作者从理论上严格证明了 RVFL 对连续函数的任意逼近特性。 Zhang 等研究 发现,输入层节点与输出层节点的直接连接对于 RVFL 的性能具有重要的影响[34] 。 图 3 随机权功能连接网络 Fig.3 FLNN with random weights 近年来,随机权单隐含层神经网络研究取得了 许多优 秀 的 成 果, 比 如 在 线 算 法[35] 、 分 布 式 算 法[36] 、集成算法[37] 、结构设计算法[38-42] 、正则化算 法[43-44] 、聚类算法[45-46] 等。 但随机权单隐含层神 经网络在大数据及知识处理方面的研究还需要进一 步加强。 2.2 随机权多隐含层前馈神经网络 与 SLFN 相比,多隐含层前馈神经网络( multi⁃ ple hidden layer feedforward neural network, MLFN) 在处理某些问题时展现出了更好的信息处理能 力[47] 。 然而,由于纵深的网络结构,梯度类算法在 训练 MLFN 时存在梯度消失及梯度爆炸问题,不能 有效发挥 MLFN 的全部性能。 深度学习方法能够有 效地训练 MLFN 网络,并在模式识别等问题上取得 很好的效果,但其整个训练过程是冗长的[48] 。 而基 于随机学习算法的多隐含层前馈神经网络,称为随 机权多隐含层前馈神经网络,仅网络的输出权值进 行训练,而隐含层节点的网络权值随机设置且固定 不变,从而极大地提高了网络的训练效率[49] 。 随机权多隐含层前馈神经网络中,随机层节点 由输入节点及隐含层节点逐层复合而成,如图 4 所 ·760· 智 能 系 统 学 报 第 11 卷

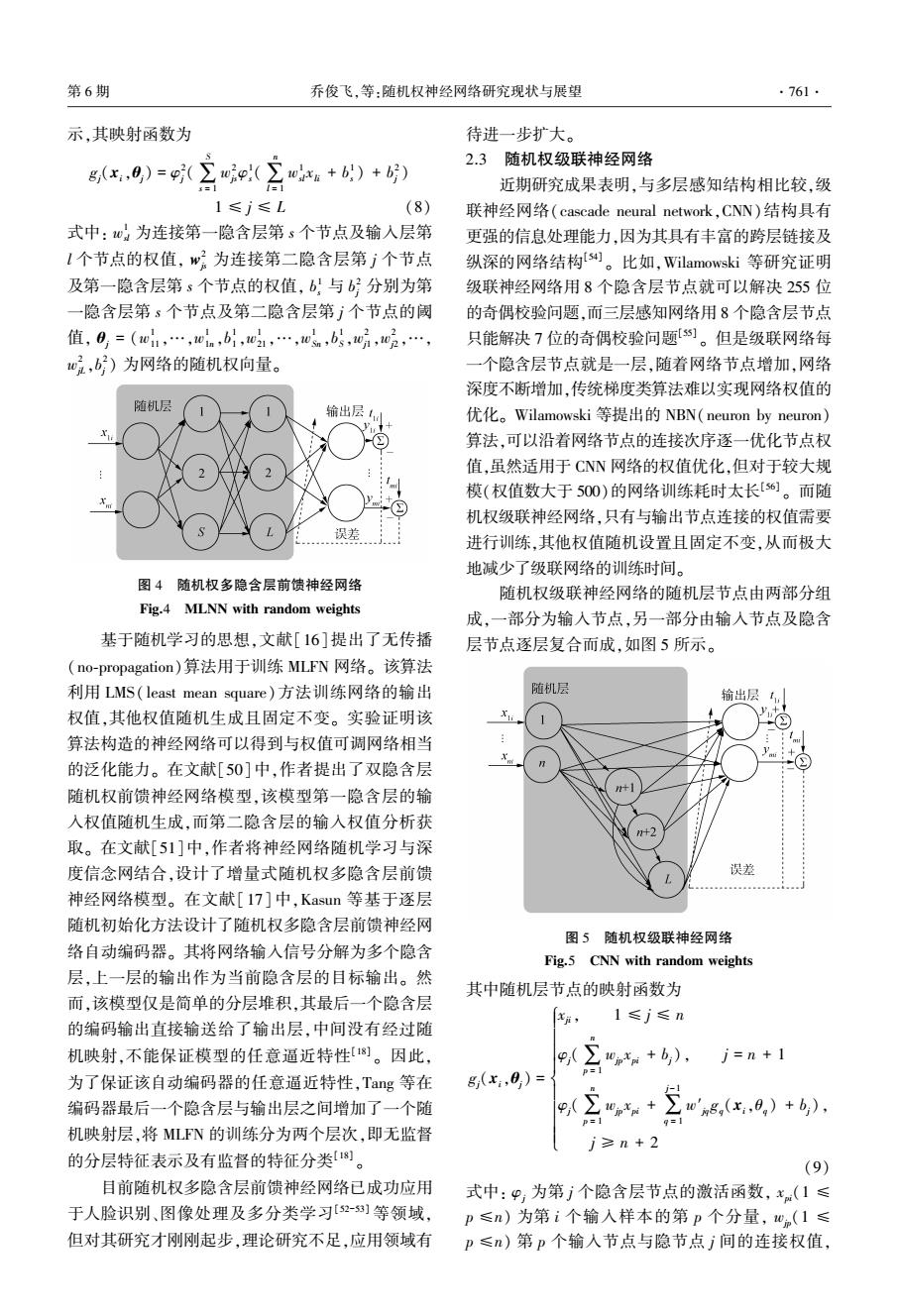

第6期 乔俊飞,等:随机权神经网络研究现状与展望 .761. 示,其映射函数为 待进一步扩大。 gx,0)=(立(立+b)+b) 2.3随机权级联神经网络 x=1 =1 近期研究成果表明,与多层感知结构相比较,级 1≤j≤L (8) 联神经网络(cascade neural network,CNN)结构具有 式中:w:为连接第一隐含层第s个节点及输入层第 更强的信息处理能力,因为其具有丰富的跨层链接及 l个节点的权值,w?为连接第二隐含层第j个节点 纵深的网络结构s。比如,Wilamowski等研究证明 及第一隐含层第s个节点的权值,b:与分别为第 级联神经网络用8个隐含层节点就可以解决255位 一隐含层第s个节点及第二隐含层第广个节点的阈 的奇偶校验问题,而三层感知网络用8个隐含层节点 值,0,=(01,…,0n,b,02,…,w5n,b5,听,02,…, 只能解决7位的奇偶校验问题约。但是级联网络每 w2,b)为网络的随机权向量。 一个隐含层节点就是一层,随着网络节点增加,网络 深度不断增加,传统梯度类算法难以实现网络权值的 随机层 输出层1 优化。Wilamowski等提出的NBN(neuron by neuron) 算法,可以沿着网络节点的连接次序逐一优化节点权 值,虽然适用于CNN网络的权值优化,但对于较大规 模(权值数大于500)的网络训练耗时太长[6]。而随 机权级联神经网络,只有与输出节点连接的权值需要 误差 进行训练,其他权值随机设置且固定不变,从而极大 地减少了级联网络的训练时间。 图4随机权多隐含层前馈神经网络 随机权级联神经网络的随机层节点由两部分组 Fig.4 MLNN with random weights 成,一部分为输入节点,另一部分由输人节点及隐含 基于随机学习的思想,文献[16]提出了无传播 层节点逐层复合而成,如图5所示。 (no-propagation)算法用于训练MLFN网络。该算法 利用LMS(least mean square)方法训练网络的输出 随机层 输出层1 权值,其他权值随机生成且固定不变。实验证明该 ② 算法构造的神经网络可以得到与权值可调网络相当 的泛化能力。在文献[50]中,作者提出了双隐含层 随机权前馈神经网络模型,该模型第一隐含层的输 入权值随机生成,而第二隐含层的输入权值分析获 取。在文献[51]中,作者将神经网络随机学习与深 度信念网结合,设计了增量式随机权多隐含层前馈 误差 神经网络模型。在文献[17]中,Kasun等基于逐层 随机初始化方法设计了随机权多隐含层前馈神经网 图5随机权级联神经网络 络自动编码器。其将网络输入信号分解为多个隐含 Fig.5 CNN with random weights 层,上一层的输出作为当前隐含层的目标输出。然 其中随机层节点的映射函数为 而,该模型仅是简单的分层堆积,其最后一个隐含层 1≤j≤n 的编码输出直接输送给了输出层,中间没有经过随 机映射,不能保证模型的任意逼近特性1)。因此, 9(∑0pn+b,), j=n+1 为了保证该自动编码器的任意逼近特性,Tang等在 8,0)= 编码器最后一个隐含层与输出层之间增加了一个随 g(+∑0g,(x,)+ p=1 9 机映射层,将MLFN的训练分为两个层次,即无监督 i≥n+2 的分层特征表示及有监督的特征分类)。 (9) 目前随机权多隐含层前馈神经网络已成功应用 式中:9,为第j个隐含层节点的激活函数,x(1≤ 于人脸识别、图像处理及多分类学习[2-]等领域, p≤n)为第i个输入样本的第p个分量,w(1≤ 但对其研究才刚刚起步,理论研究不足,应用领域有 p≤n)第p个输入节点与隐节点j间的连接权值

示,其映射函数为 gj(xi,θj) = φ 2 j (∑ S s = 1 w 2 jsφ 1 s(∑ n l = 1 w 1 sl xli + b 1 s ) + b 2 j ) 1 ≤ j ≤ L (8) 式中: w 1 sl 为连接第一隐含层第 s 个节点及输入层第 l 个节点的权值, w 2 js 为连接第二隐含层第 j 个节点 及第一隐含层第 s 个节点的权值, b 1 s 与 b 2 j 分别为第 一隐含层第 s 个节点及第二隐含层第 j 个节点的阈 值, θj = (w 1 11 ,…,w 1 1n ,b 1 1 ,w 1 21 ,…,w 1 Sn ,b 1 S ,w 2 j1 ,w 2 j2 ,…, w 2 jL ,b 2 j ) 为网络的随机权向量。 图 4 随机权多隐含层前馈神经网络 Fig.4 MLNN with random weights 基于随机学习的思想,文献[16]提出了无传播 (no⁃propagation)算法用于训练 MLFN 网络。 该算法 利用 LMS( least mean square)方法训练网络的输出 权值,其他权值随机生成且固定不变。 实验证明该 算法构造的神经网络可以得到与权值可调网络相当 的泛化能力。 在文献[50]中,作者提出了双隐含层 随机权前馈神经网络模型,该模型第一隐含层的输 入权值随机生成,而第二隐含层的输入权值分析获 取。 在文献[51]中,作者将神经网络随机学习与深 度信念网结合,设计了增量式随机权多隐含层前馈 神经网络模型。 在文献[17]中,Kasun 等基于逐层 随机初始化方法设计了随机权多隐含层前馈神经网 络自动编码器。 其将网络输入信号分解为多个隐含 层,上一层的输出作为当前隐含层的目标输出。 然 而,该模型仅是简单的分层堆积,其最后一个隐含层 的编码输出直接输送给了输出层,中间没有经过随 机映射,不能保证模型的任意逼近特性[18] 。 因此, 为了保证该自动编码器的任意逼近特性,Tang 等在 编码器最后一个隐含层与输出层之间增加了一个随 机映射层,将 MLFN 的训练分为两个层次,即无监督 的分层特征表示及有监督的特征分类[18] 。 目前随机权多隐含层前馈神经网络已成功应用 于人脸识别、图像处理及多分类学习[52-53] 等领域, 但对其研究才刚刚起步,理论研究不足,应用领域有 待进一步扩大。 2.3 随机权级联神经网络 近期研究成果表明,与多层感知结构相比较,级 联神经网络(cascade neural network,CNN)结构具有 更强的信息处理能力,因为其具有丰富的跨层链接及 纵深的网络结构[54] 。 比如,Wilamowski 等研究证明 级联神经网络用 8 个隐含层节点就可以解决 255 位 的奇偶校验问题,而三层感知网络用 8 个隐含层节点 只能解决 7 位的奇偶校验问题[55] 。 但是级联网络每 一个隐含层节点就是一层,随着网络节点增加,网络 深度不断增加,传统梯度类算法难以实现网络权值的 优化。 Wilamowski 等提出的 NBN(neuron by neuron) 算法,可以沿着网络节点的连接次序逐一优化节点权 值,虽然适用于 CNN 网络的权值优化,但对于较大规 模(权值数大于 500)的网络训练耗时太长[56] 。 而随 机权级联神经网络,只有与输出节点连接的权值需要 进行训练,其他权值随机设置且固定不变,从而极大 地减少了级联网络的训练时间。 随机权级联神经网络的随机层节点由两部分组 成,一部分为输入节点,另一部分由输入节点及隐含 层节点逐层复合而成,如图 5 所示。 图 5 随机权级联神经网络 Fig.5 CNN with random weights 其中随机层节点的映射函数为 gj(xi,θj) = xji, 1 ≤ j ≤ n φj(∑ n p = 1 wjp xpi + bj), j = n + 1 φj(∑ n p = 1 wjp xpi + ∑ j-1 q = 1 w′jqgq(xi,θq) + bj), j ≥ n + 2 ì î í ï ï ï ï ï ï ï ï (9) 式中: φj 为第 j 个隐含层节点的激活函数, xpi(1 ≤ p ≤n) 为第 i 个输入样本的第 p 个分量, wjp(1 ≤ p ≤n) 第 p 个输入节点与隐节点 j 间的连接权值, 第 6 期 乔俊飞,等:随机权神经网络研究现状与展望 ·761·

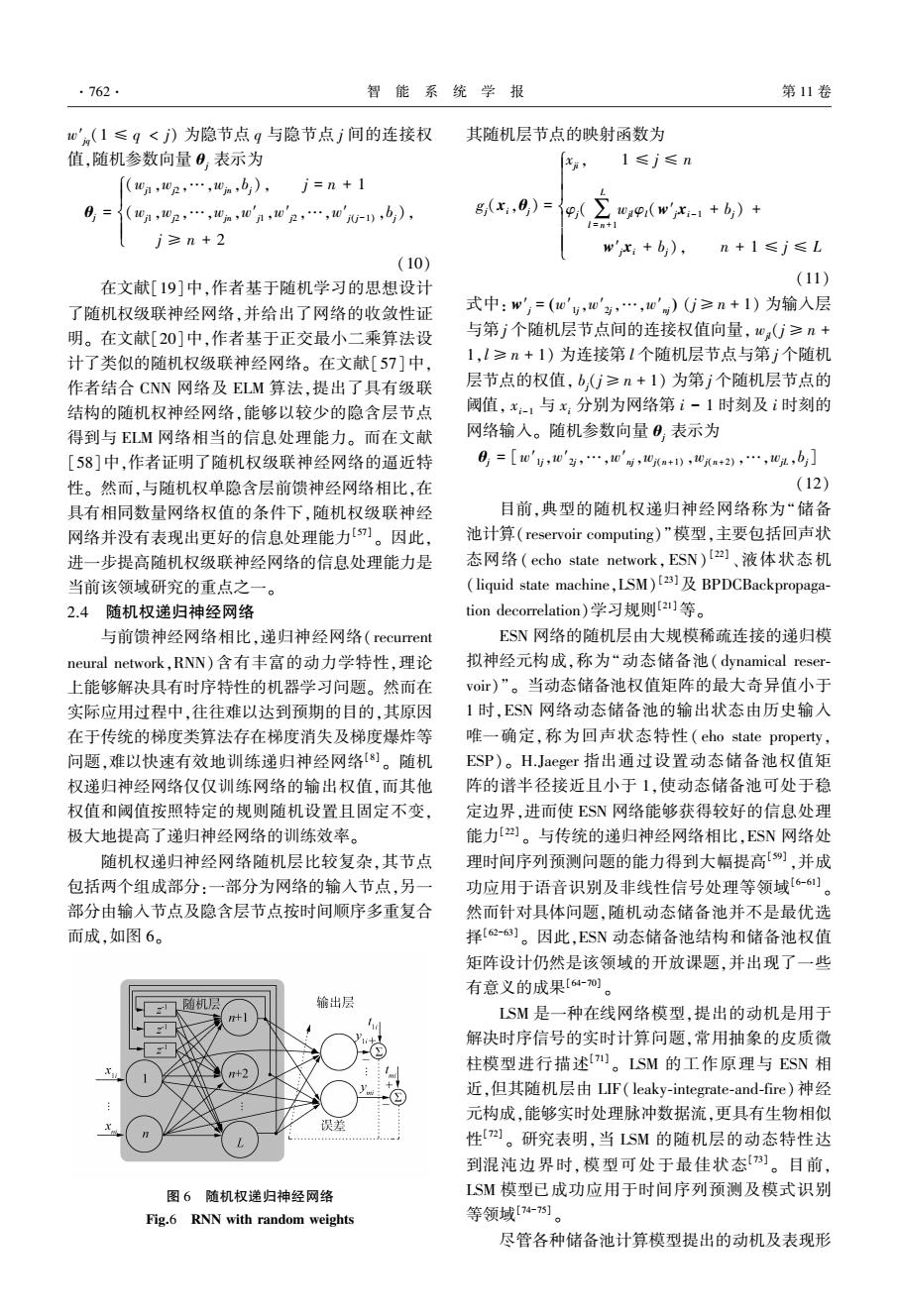

.762. 智能系统学报 第11卷 o'(1≤q<j)为隐节点q与隐节点j间的连接权 其随机层节点的映射函数为 值,随机参数向量0,表示为 ' 1≤j≤n (0,02,…,0n,b), j=n+1 0= (01,02,…,wm,0'n0'2,…,0't-),b), 8(x:,0)= 9(】 5,9(w51+6》+ 1=用+1 j≥n+2 w'x:+b), n+1≤j≤L (10) 在文献[19]中,作者基于随机学习的思想设计 (11) 了随机权级联神经网络,并给出了网络的收敛性证 式中:w,=(0',0'5,…,w'g)(≥n+1)为输入层 明。在文献[20]中,作者基于正交最小二乘算法设 与第j个随机层节点间的连接权值向量,0()≥n+ 计了类似的随机权级联神经网络。在文献[57]中, 1,l≥n+1)为连接第l个随机层节点与第j个随机 作者结合CNN网络及ELM算法,提出了具有级联 层节点的权值,b,(G≥n+1)为第j个随机层节点的 结构的随机权神经网络,能够以较少的隐含层节点 阈值,x-1与x:分别为网络第i-1时刻及i时刻的 得到与ELM网络相当的信息处理能力。而在文献 网络输入。随机参数向量0:表示为 [58]中,作者证明了随机权级联神经网络的逼近特 0=0'5,0'3,…,0'm时,0a+D,0a+2y,…,02,b] 性。然而,与随机权单隐含层前馈神经网络相比,在 (12) 具有相同数量网络权值的条件下,随机权级联神经 目前,典型的随机权递归神经网络称为“储备 网络并没有表现出更好的信息处理能力[5。因此, 池计算(reservoir computing)”模型,主要包括回声状 进一步提高随机权级联神经网络的信息处理能力是 态网络(echo state network,ESN)[2]、液体状态机 当前该领域研究的重点之一。 liquid state machine,LSM)[2]BPDCBackpropaga- 2.4随机权递归神经网络 tion decorrelation)学习规则[2]等。 与前馈神经网络相比,递归神经网络(recurrent ESN网络的随机层由大规模稀疏连接的递归模 neural network,RNN)含有丰富的动力学特性,理论 拟神经元构成,称为“动态储备池(dynamical reser- 上能够解决具有时序特性的机器学习问题。然而在 voir)”。当动态储备池权值矩阵的最大奇异值小于 实际应用过程中,往往难以达到预期的目的,其原因 1时,ESN网络动态储备池的输出状态由历史输入 在于传统的梯度类算法存在梯度消失及梯度爆炸等 唯一确定,称为回声状态特性(eho state property, 问题,难以快速有效地训练递归神经网络]。随机 ESP)。H.Jaeger指出通过设置动态储备池权值矩 权递归神经网络仅仅训练网络的输出权值,而其他 阵的谱半径接近且小于1,使动态储备池可处于稳 权值和阈值按照特定的规则随机设置且固定不变, 定边界,进而使ESN网络能够获得较好的信息处理 极大地提高了递归神经网络的训练效率。 能力[2]。与传统的递归神经网络相比,ESN网络处 随机权递归神经网络随机层比较复杂,其节点 理时间序列预测问题的能力得到大幅提高s9),并成 包括两个组成部分:一部分为网络的输入节点,另一 功应用于语音识别及非线性信号处理等领域[6-61)]。 部分由输入节点及隐含层节点按时间顺序多重复合 然而针对具体问题,随机动态储备池并不是最优选 而成,如图6。 择[62-]。因此,ESN动态储备池结构和储备池权值 矩阵设计仍然是该领域的开放课题,并出现了一些 有意义的成果[64-0]。 输出层 LSM是一种在线网络模型,提出的动机是用于 解决时序信号的实时计算问题,常用抽象的皮质微 柱模型进行描述m。LSM的工作原理与ESN相 近,但其随机层由LIF(leaky-integrate-and-fire)神经 元构成,能够实时处理脉冲数据流,更具有生物相似 误差 性。研究表明,当LSM的随机层的动态特性达 到混沌边界时,模型可处于最佳状态]。目前, 图6随机权递归神经网络 LSM模型已成功应用于时间序列预测及模式识别 Fig.6 RNN with random weights 等领域[4-) 尽管各种储备池计算模型提出的动机及表现形

w′jq(1 ≤ q < j) 为隐节点 q 与隐节点 j 间的连接权 值,随机参数向量 θj 表示为 θj = (wj1 ,wj2 ,…,wjn ,bj), j = n + 1 (wj1 ,wj2 ,…,wjn ,w′j1 ,w′j2 ,…,w′j(j-1) ,bj), j ≥ n + 2 ì î í ï ï ïï (10) 在文献[19]中,作者基于随机学习的思想设计 了随机权级联神经网络,并给出了网络的收敛性证 明。 在文献[20]中,作者基于正交最小二乘算法设 计了类似的随机权级联神经网络。 在文献[57]中, 作者结合 CNN 网络及 ELM 算法,提出了具有级联 结构的随机权神经网络,能够以较少的隐含层节点 得到与 ELM 网络相当的信息处理能力。 而在文献 [58]中,作者证明了随机权级联神经网络的逼近特 性。 然而,与随机权单隐含层前馈神经网络相比,在 具有相同数量网络权值的条件下,随机权级联神经 网络并没有表现出更好的信息处理能力[57] 。 因此, 进一步提高随机权级联神经网络的信息处理能力是 当前该领域研究的重点之一。 2.4 随机权递归神经网络 与前馈神经网络相比,递归神经网络( recurrent neural network,RNN)含有丰富的动力学特性,理论 上能够解决具有时序特性的机器学习问题。 然而在 实际应用过程中,往往难以达到预期的目的,其原因 在于传统的梯度类算法存在梯度消失及梯度爆炸等 问题,难以快速有效地训练递归神经网络[8] 。 随机 权递归神经网络仅仅训练网络的输出权值,而其他 权值和阈值按照特定的规则随机设置且固定不变, 极大地提高了递归神经网络的训练效率。 随机权递归神经网络随机层比较复杂,其节点 包括两个组成部分:一部分为网络的输入节点,另一 部分由输入节点及隐含层节点按时间顺序多重复合 而成,如图 6。 图 6 随机权递归神经网络 Fig.6 RNN with random weights 其随机层节点的映射函数为 gj(xi,θj) = xji, 1 ≤ j ≤ n φj(∑ L l = n+1 wjlφl(w′jxi-1 + bj) + w′jxi + bj), n + 1 ≤ j ≤ L ì î í ï ï ï ï ï ï (11) 式中: w′j = w′1j,w′2j,…,w′nj ( ) (j≥n + 1) 为输入层 与第 j 个随机层节点间的连接权值向量, wjl(j ≥ n + 1,l ≥ n + 1) 为连接第 l 个随机层节点与第 j 个随机 层节点的权值, bj(j≥n + 1) 为第 j 个随机层节点的 阈值, xi-1 与 xi 分别为网络第 i - 1 时刻及 i 时刻的 网络输入。 随机参数向量 θj 表示为 θj = [w′1j,w′2j,…,w′nj,wj(n+1) ,wj(n+2) ,…,wjL ,bj] (12) 目前,典型的随机权递归神经网络称为“储备 池计算(reservoir computing)”模型,主要包括回声状 态网络( echo state network,ESN) [22] 、液体状态机 (liquid state machine,LSM) [23]及 BPDCBackpropaga⁃ tion decorrelation)学习规则[21]等。 ESN 网络的随机层由大规模稀疏连接的递归模 拟神经元构成,称为“动态储备池( dynamical reser⁃ voir)”。 当动态储备池权值矩阵的最大奇异值小于 1 时,ESN 网络动态储备池的输出状态由历史输入 唯一确定,称为回声状态特性( eho state property, ESP)。 H.Jaeger 指出通过设置动态储备池权值矩 阵的谱半径接近且小于 1,使动态储备池可处于稳 定边界,进而使 ESN 网络能够获得较好的信息处理 能力[22] 。 与传统的递归神经网络相比,ESN 网络处 理时间序列预测问题的能力得到大幅提高[59] ,并成 功应用于语音识别及非线性信号处理等领域[6-61] 。 然而针对具体问题,随机动态储备池并不是最优选 择[62-63] 。 因此,ESN 动态储备池结构和储备池权值 矩阵设计仍然是该领域的开放课题,并出现了一些 有意义的成果[64-70] 。 LSM 是一种在线网络模型,提出的动机是用于 解决时序信号的实时计算问题,常用抽象的皮质微 柱模型进行描述[71] 。 LSM 的工作原理与 ESN 相 近,但其随机层由 LIF( leaky⁃integrate⁃and⁃fire)神经 元构成,能够实时处理脉冲数据流,更具有生物相似 性[72] 。 研究表明,当 LSM 的随机层的动态特性达 到混沌边界时,模型可处于最佳状态[73] 。 目前, LSM 模型已成功应用于时间序列预测及模式识别 等领域[74-75] 。 尽管各种储备池计算模型提出的动机及表现形 ·762· 智 能 系 统 学 报 第 11 卷