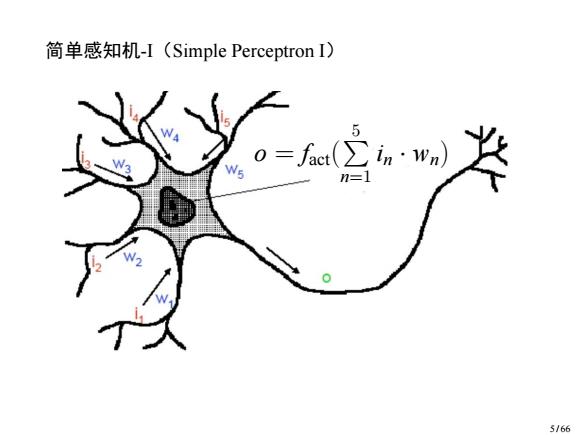

简单感知机-I(Simple Perceptron I) 5 5/66

简单感知机-I(Simple Perceptron I) o = fact( P 5 n=1 in · wn) 5 / 66

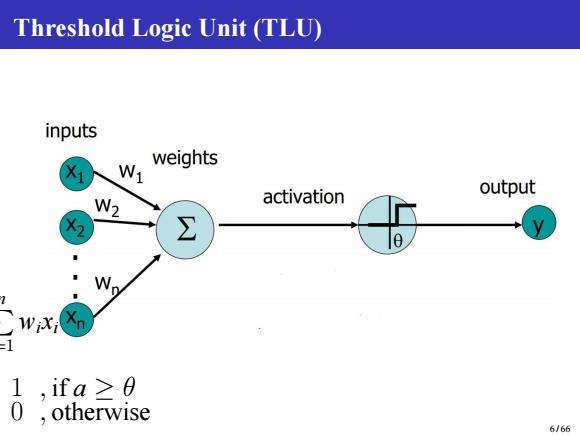

Threshold Logic Unit (TLU) inputs W1 weights output W2 activation =1 1,ifa≥0 0,otherwise 6/66

Threshold Logic Unit (TLU) a = P n i=1 wixi y = n 1 , if a ≥ θ 0 , otherwise 6 / 66

Activation Functions(激活函数) threshold linear 二 x)=中 piece-wise linear sigmoid f=f(x)(1-f(x) E:0 S形(Sigmoid)函数:连 续,光滑,严格单调, 关于(0,0.5)中心对称的 阈值函数。 7/66

Activation Functions(激活函数) fs(x) = 1 1+e−x f ′ s = f (x)(1 − f (x)) S 形 (Sigmoid) 函数:连 续,光滑,严格单调, 关于 (0,0.5) 中心对称的 阈值函数。 7 / 66

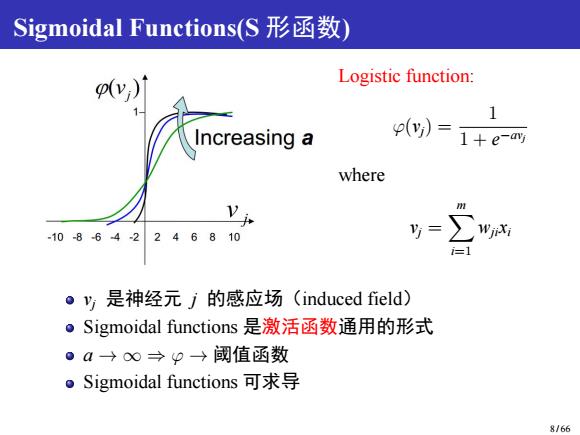

Sigmoidal Functions(S形函数) v) Logistic function: 1 p(y)= 1+e-y where -10-864-2246810 i=1 ·y是神经元j的感应场(induced field). ·Sigmoidal functions是激活函数通用的形式 。a→0∞→P→阈值函数 。Sigmoidal functions可求导 8/66

Sigmoidal Functions(S 形函数) Logistic function: φ(vj) = 1 1 + e −avj where vj = Xm i=1 wjixi vj 是神经元 j 的感应场(induced field) Sigmoidal functions 是激活函数通用的形式 a → ∞ ⇒ φ → 阈值函数 Sigmoidal functions 可求导 8 / 66

7.2.1.采用线性激活函数的神经元 inputs weights X1 N output W2 activation ∑ a n y=p(a=a=∑ WiXi 9166

7.2.1. 采用线性激活函数的神经元 a = P n i=1 wixi y = φ(a) = a = P n i=1 wixi 9 / 66