第五章突触动力学Ⅱ:有监督学习 神经网络的分类 按网络结构分为:反馈网络和前馈网络: 按学习方式分为:监督学习和非监督学习。 本章主要论述前馈网络的监督学习算法,包括感知器 算法、最小均方误差算法和反向传播(BP)算法。 本章论述了监督学习是对未知平均误差层的随机近似, 即给定观察得到的随机矢量样本对: (x,y),(x22)2(xmym) 要估计一个未知函数:f:x一y,并且使期望误差函 数EJ]最小。误差定义为期望特性与实际特性之差

第五章 突触动力学Ⅱ:有监督学习 神经网络的分类 按网络结构分为:反馈网络和前馈网络; 按学习方式分为:监督学习和非监督学习。 本章主要论述前馈网络的监督学习算法,包括感知器 算法、最小均方误差算法和反向传播(BP) 算法。 本章论述了监督学习是对未知平均误差层的随机近似, 即给定观察得到的随机矢量样本对: 1 1 2 2 ( , ), ( , ), ( , ) m m x y x y x y 要估计一个未知函数:f : x—y,并且使期望误差函 数E[J]最小。误差定义为期望特性与实际特性之差

第五章突触动力学[:有监督学习 隐层 输入节点 输出 计算单元 上图即为前馈神经网络的结构示意图。各神经元接 受前一级输入,并输出到下一级,无反馈。输入、 输出节点称为可见层,其他中间层称为隐层

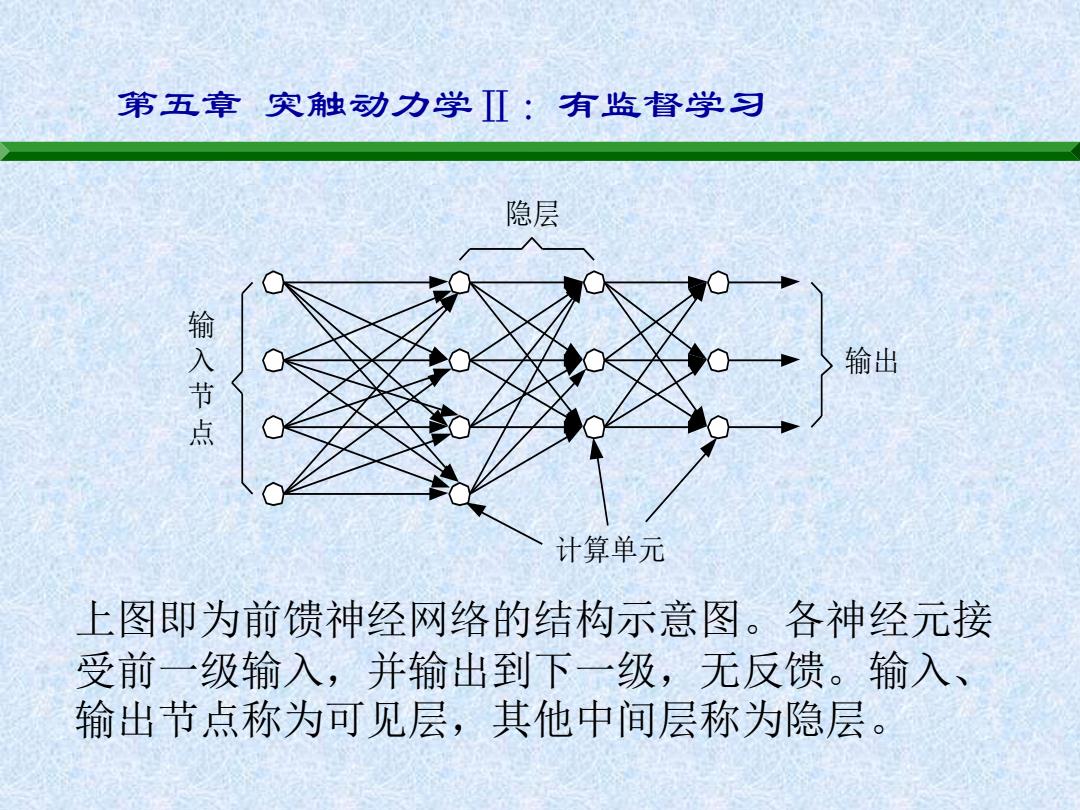

第五章 突触动力学Ⅱ:有监督学习 输出 隐层 输 入 节 点 计算单元 上图即为前馈神经网络的结构示意图。各神经元接 受前一级输入,并输出到下一级,无反馈。输入、 输出节点称为可见层,其他中间层称为隐层

第五章突触动力学Ⅱ:有监督学习 当现有的先验知识不完全时,就需要学习。学 习的方式取决于这一先验信息不完全的程度。在 监督学习过程中,假设已知未来学习系统的期望 响应,并且使用期望值与实际值的差值(即学习 系统的误差)去修正系统的行为。而在非监督学 习中是不了解学习系统的期望响应的。 神经网络通过向环境获取知识并改进自身性能。 般是按某种预定的度量调节自身的参数(如权 值)随时间逐步达到的

第五章 突触动力学Ⅱ:有监督学习 当现有的先验知识不完全时,就需要学习。学 习的方式取决于这一先验信息不完全的程度。在 监督学习过程中,假设已知未来学习系统的期望 响应,并且使用期望值与实际值的差值(即学习 系统的误差)去修正系统的行为。而在非监督学 习中是不了解学习系统的期望响应的。 神经网络通过向环境获取知识并改进自身性能。 一般是按某种预定的度量调节自身的参数(如权 值)随时间逐步达到的

第五章突触动力学Ⅱ:有监督学习 监督学习有时也叫有教师学习,“教师”在这 里要对一组给定的输入提供应有的输出结果。这 组己知的输入一输出数据就称为训练样本集。学 习系统如下图: 描述环境状态 环境 的信号 教师 应有 响应 学习 实际响应 系统 误差信号

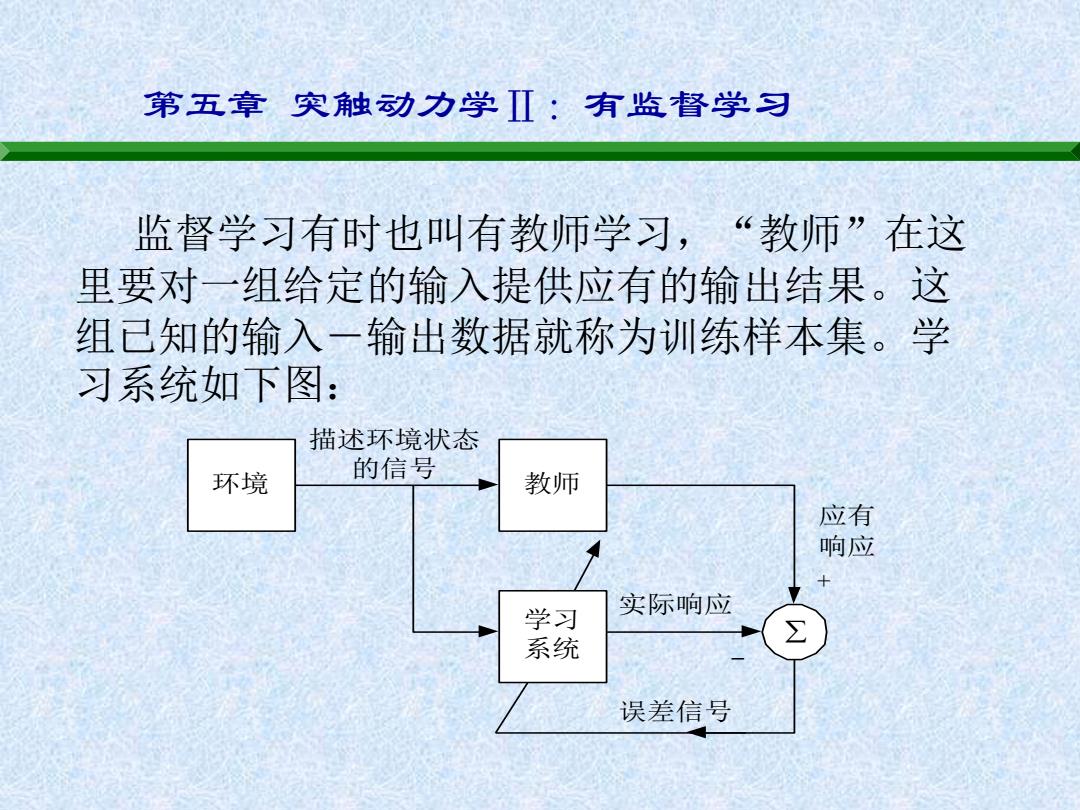

第五章 突触动力学Ⅱ:有监督学习 监督学习有时也叫有教师学习,“教师”在这 里要对一组给定的输入提供应有的输出结果。这 组已知的输入-输出数据就称为训练样本集。学 习系统如下图: 环境 教师 学习 系统 实际响应 误差信号 应有 响应 描述环境状态 的信号 + -

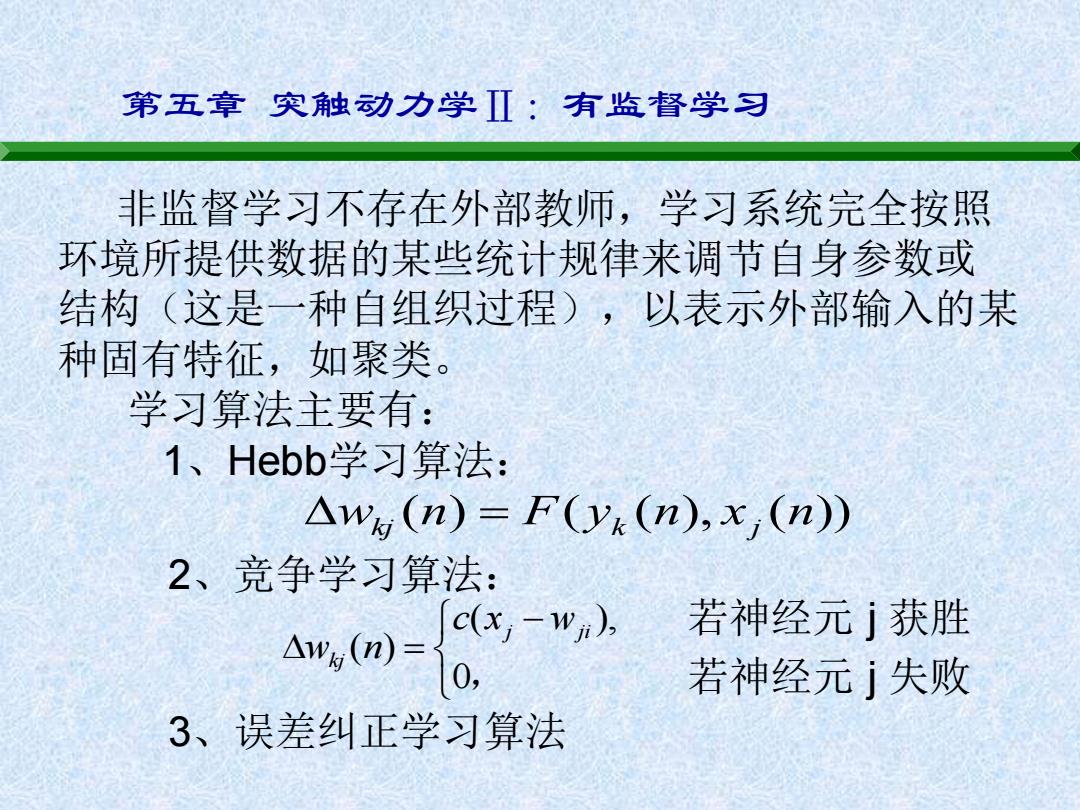

第五章突触动力学Ⅱ:有监督学习 非监督学习不存在外部教师,学习系统完全按照 环境所提供数据的某些统计规律来调节自身参数或 结构(这是一种自组织过程),以表示外部输入的某 种固有特征,如聚类。 学习算法主要有: 1、Hebb学习算法: △w(n)=F(yk(n),x,(n) 2、竞争学习算法: A() c(x-wn), 若神经元j获胜 0, 若神经元j失败 3、误差纠正学习算法

第五章 突触动力学Ⅱ:有监督学习 非监督学习不存在外部教师,学习系统完全按照 环境所提供数据的某些统计规律来调节自身参数或 结构(这是一种自组织过程),以表示外部输入的某 种固有特征,如聚类。 学习算法主要有: 1、Hebb学习算法: ( ) ( ( ), ( )) = w n F y n x n kj k j 2、竞争学习算法: ( ), ( ) 0 j ji kj c x w w n − = , 3、误差纠正学习算法 若神经元 j 获胜 若神经元 j 失败