第1章绪论 型的分析结果提示奥巴马应去何处开展拉票活动,有些建议甚至让专业竞选顾 问大吃一惊,而结果表明去这些地方大有收获.总统选举需要大量金钱,机器 学习技术在这方面发挥了奇效.例如,机器学习模型分析出,某电影明星对某 地区某年龄段的特定人群很有吸引力,而这个群体很愿意出高价与该明星及奥 巴马共进晚餐…果然,这样一次筹资晚宴成功募集到1500万美元;最终,借 助机器学习模型,奥巴马筹到了创纪录的10亿美元竞选经费.机器学习技术不 仅有助于竞选经费“开源”,还可帮助“节流”,例如机器学习模型通过对不 同群体选民进行分析,建议购买了一些冷门节目的广告时段,而没有采用在昂 贵的黄金时段购买广告的传统做法,使得广告资金效率相比2008年竞选提高 了14%;…胜选后,《时代》周刊专门报道了这个被奥巴马称为“竞选核武 器”、由半监督学习研究专家R.Ghani领导的团队 值得一提的是,机器学习备受瞩目当然是由于它已成为智能数据分析技术 的创新源泉,但机器学习研究还有另一个不可忽视的意义,即通过建立一些关 于学习的计算模型来促进我们理解“人类如何学习”.例如,卫.Kanerva在二 十世纪八十年代中期提出SDM(Sparse Distributed Memory)模型Kanerva 1988!时并没有刻意模仿脑生理结构,但后来神经科学的研究发现,SDM的稀 疏编码机制在视觉、听觉、噢觉功能的脑皮层中广泛存在,从而为理解脑的某 些功能提供了一定的启发.自然科学研究的驱动力归结起来无外是人类对宇宙 本源、万物本质、生命本性、自我本识的好奇,而“人类如何学习”无疑是 个有关自我本识的重大问题.从这个意义上说,机器学习不仅在信息科学中占 有重要地位,还具有一定的自然科学探索色彩 1.7阅读材料 Mitchell,1997]是第一本机器学习专门性教材,Duda et al.,2001;A paydin,2004;Flach,2012都是出色的入门读物.日astie et al,.200g是很好 的进阶读物,Bishop,2006也很有参考价值,尤其适合于贝叶斯学习偏好者, [Shalev-Shwartz and Ben-David,20l4则适合于理论偏好者.Witten et al.. WEKA是著名的免费 2011]是基于WEKA撰写的入门读物,有助于初学者通过WEKA实践快速掌 握常用机器学习算法。 本书1.5和1.6节主要取材于周志华,2007.《机器学习:一种人工智能 途径》Michalski et al,.1983汇集了20位学者撰写的16篇文章,是机器学习 早期最重要的文献.该书出版后产生了很大反响,Morgan Kaufmann出版社后 来分别于1986年和1990年出版了该书的续篇,编为第二卷和第三卷.《人工

1.7阅读材料 智能手册》系列是图灵奖得主E.A.Feigenbaum与不同学者合作编写而成,该 书第三卷[Cohen and Feigenbaum,1983对机器学习进行了讨论,是机器学习 早期的重要文献.Dietterich,1997对机器学习领域的发展进行了评述和展望. 早期的很多文献在今天仍值得重视,一些闪光的思想在相关技术进步后可能焕 发新的活力,例如近来流行的“迁移学习”(transfer learning)Pan and Yang 2010,恰似“类比学习”(learning by analogy)在统计学习技术大发展后的升 级版;红极一时的“深度学习”(deep learning)在思想上并未显著超越二十世 深度学习参见5.6节。 纪八十年代中后期神经网络学习的研究. 机器学习中关于概念学习的研究开始很早,从中产生的不少思想对整个 领域都有深远影响.例如作为主流学习技术之一的决策树学习,就起源于关 于概念形成的树结构研究Hunt and Hovland,1963.Winston,1970j在著 名的“积木世界”研究中,将概念学习与基于泛化和特化的搜索过程联系起 来.[Simon and Lea,l974较早提出了“学习”是在假设空间中搜索的观点, MthL,1977]稍后提出了版本空间的概念.概念学习中有很多关于规则学习 规则学习泰见第15章 的内容 奥卡姆剃刀原则主张选择与经验观察一致的最简单假设,它在自然科学如 物理学、天文学等领域中是一个广为沿用的基础性原则,例如哥白尼坚持“日 心说”的理由之一就是它比托勒密的“地心说”更简单且符合天文观测。奥 卡姆剃刀在机器学习领域也有很多追随者Blumer et al.,l996.但机器学习 中什么是“更简单的”这个问题一直困扰着研究者们,因此,对奥卡姆剃刀在 机器学习领域的作用一直存在着争议[Webb,1996;Domingos,.1999.需注意 的是,奥卡姆剃刀并非科学研究中唯一可行的假设选择原则,例如古希腊哲学 家伊壁鸠鲁(公元前341年-前270年)提出的“多释原则”(principle of multiple explanations),主张保留与经验观察一致的所有假设[Asmis,1984,这与集成 集成学习参见第8章。 学习(ensemble learning)方面的研究更加吻合. 机器学习领域最重要的国际学术会议是国际机器学习会议(ICML)、国际 神经信息处理系统会议(NPS)和国际学习理论会议(COLT),重要的区域性会 议主要有欧洲机器学习会议(ECML)和亚洲机器学习会议(ACML);最重要的 国际学术期刊是Journal o时Machine Learning Research和Machine Learning.. 人工智能领域的重要会议如IJCAI、AAAI以及重要期刊如Artificial Intell gence、Journal of Artificial Intelligence Research,数据挖掘领域的重要会议 如KDD、ICDM以及重要期f刊如ACM Transactions on Knowledge Discovery rom Data、Data Mining and Knowledge Discovery,计算机视觉与模式识别

第1章绪论 领域的重要会议如CVPR以及重要期刊如IEEE Transactions on Pattern Analysis and Machine Intelligence,神经网络领域的重要期刊如Neural Com- putation.IEEE Transactions on Neural Networks and Learning Systems 也经常发表机器学习方面的论文.此外,统计学领域的重要期刊如Annals o时 Statistics等也常有关于统计学习方面的理论文章发表. 国内不少书籍包含机器学习方面的内容,例如陆汝钤,19961.李航,2012) 是以统计学习为主题的读物.国内机器学习领域最主要的活动是两年一次 的中国机器学习大会(CCML)以及每年举行的“机器学习及其应用”研讨 会(MLA;很多学术刊物都经常刊登有关机器学习的论文

习题 19 习题 1.1表1.1中若只包含编号为1和4的两个样例,试给出相应的版本空间 1.2与使用单个合取式来进行假设表示相比,使用“析合范式”将使得假 设空间具有更强的表示能力.例如 好瓜:((色泽=*)Λ(根蒂=蜷缩)Λ(敲声=*)) V(色泽=乌黑)A(根蒂=)A(敲声=沉闷), 会把“(色泽=青绿)Λ(根蒂=蜷缩)Λ(敲声=清脆)”以及“(色泽= 乌黑)Λ(根蒂=硬挺)Λ(敲声=沉闷)”都分类为“好瓜”.若使用最 提示:注意冗余情况, 如(A=a)V(A=) 多包含k个合取式的析合范式来表达表1.1西瓜分类问题的假设空 与(A■*)等价 间,试估算共有多少种可能的假设. 1.3 若数据包含噪声,则假设空间中有可能不存在与所有训练样本都一致 的假设.在此情形下,试设计一种归纳偏好用于假设选择, 1.4本章1.4节在论述“没有免费的午餐”定理时,默认使用了“分类错 误率”作为性能度量来对分类器进行评估.若换用其他性能度量¢,则 式(1.1)将改为 Eate(calX,f)=∑∑P(e)e(h(e),f(e)P(h|X,a), h sex-x 试证明“没有免费的午餐定理”仍成立. 1.5试述机器学习能在互联网搜索的哪些环节起什么作用

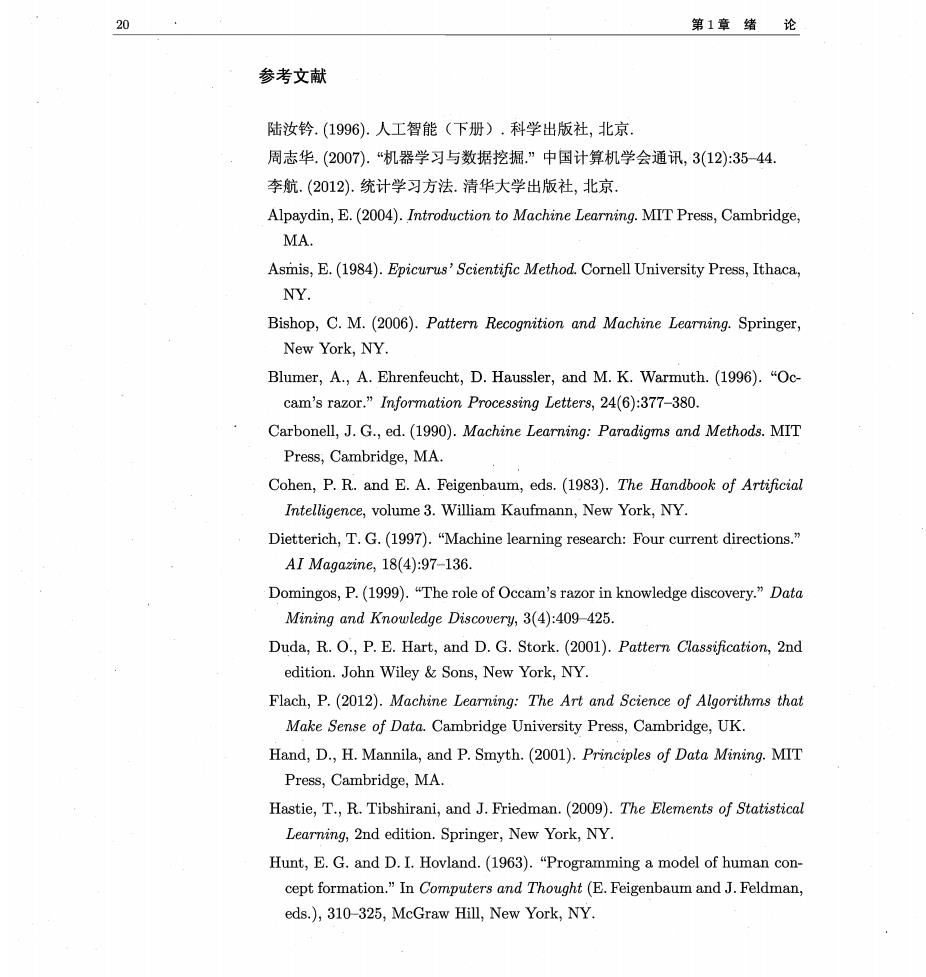

20 第1章绪论 参考文献 陆汝钤.(1996).人工智能(下册),科学出版社,北京 周志华.(2007).“机器学习与数据挖掘.”中国计算机学会通讯,3(12):3544 李航.(2012).统计学习方法.清华大学出版社,北京。 Alpaydin,E.(2004).Introduction to Machine Learning.MIT Press,Cambridge, MA. Asmis,E.(1984).Epicurus'Scientific Method.Cornell University Press,Ithaca, NY. Bishop,C.M.(2006).Pattern Recognition and Machine Learning.Springer New York,NY. Blumer,A.,A.Ehrenfeucht,D.Haussler,and M.K.Warmuth.(1996)."Oc- cam's razor."Information Processing Letters,24(6):377-380. Carbonell,J.G.,ed.(1990).Machine Learning:Paradigms and Methods.MIT Press,Cambridge,MA. Cohen,P.R.and E.A.Feigenbaum,eds.(1983).The Handbook of Artificial Intelligence,volume 3.William Kaufmann,New York,NY. Dietterich,T.G(1997)."Machine learning research:Four current directions AI Magazine,18(4):97-136. Domingos,P.(1999)."The role of Occam's razor in knowledge discovery."Data Mining and Knowledge Discovery,3(4):409-425. Duda,R.O.,P.E.Hart,and D.G.Stork.(2001).Pattern Classification,2nd edition.John Wiley Sons,New York,NY. Flach,P.(2012).Machine Learning:The Art and Science of Algorithms that Make Sense of Data.Cambridge University Press,Cambridge,UK. Hand,D.,H.Mannila,and P.Smyth.(2001).Principles of Data Mining.MIT Press,Cambridge,MA. Hastie,T.,R.Tibshirani,and J.Friedman.(2009).The Elements of Statistical Learning,2nd edition.Springer,New York,NY. Hunt,E.G.and D.I.Hovland.(1963)."Programming a model of human con- cept formation."In Computers and Thought(E.Feigenbaum and J.Feldman, eds.),310-325,McGraw Hill,New York,NY