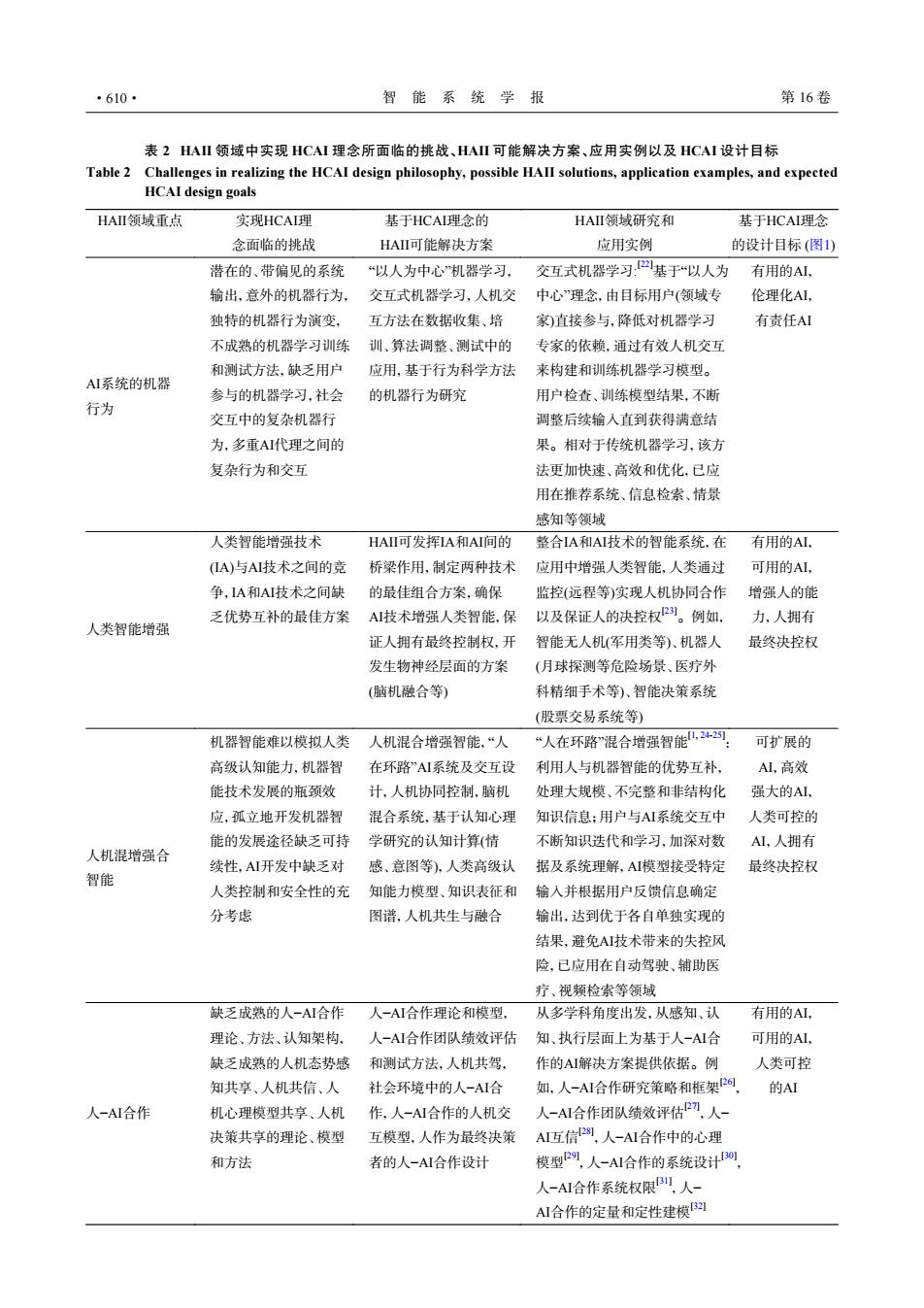

·610· 智能系统学报 第16卷 表2HAⅡ领域中实现HCAI理念所面临的挑战、HAⅡ可能解决方案、应用实例以及HCAI设计目标 Table 2 Challenges in realizing the HCAI design philosophy,possible HAII solutions,application examples,and expected HCAI design goals HAⅡ领域重点 实现HCAI理 基于HCAI理念的 HAⅡ领域研究和 基于HCAI理念 念面临的挑战 HAII可能解决方案 应用实例 的设计目标(图1) 潜在的、带偏见的系统 “以人为中心”机器学习. 交互式机器学习.基于“以人为 有用的AL. 输出,意外的机器行为, 交互式机器学习,人机交 中心”理念,由目标用户(领域专 伦理化AI, 独特的机器行为演变, 互方法在数据收集、培 家)直接参与,降低对机器学习 有责任AI 不成熟的机器学习训练 训、算法调整、测试中的 专家的依赖,通过有效人机交互 和测试方法,缺乏用户 应用,基于行为科学方法 来构建和训练机器学习模型。 AI系统的机器 参与的机器学习.社会 的机器行为研究 用户检查、训练模型结果,不断 行为 交互中的复杂机器行 调整后续输入直到获得满意结 为,多重AI代理之间的 果。相对于传统机器学习,该方 复杂行为和交互 法更加快速、高效和优化,已应 用在推荐系统、信息检索、情景 感知等领域 人类智能增强技术 HAI可发挥IA和AI间的 整合IA和AI技术的智能系统,在 有用的AI. (IA)与AI技术之间的竞 桥梁作用,制定两种技术应用中增强人类智能,人类通过 可用的AL. 争,IA和AI技术之间缺 的最佳组合方案,确保 监控(远程等)实现人机协同合作 增强人的能 乏优势互补的最佳方案 AI技术增强人类智能,保 以及保证人的决控权P。例如。 力,人拥有 人类智能增强 证人拥有最终控制权,开 智能无人机(军用类等)、机器人 最终决控权 发生物神经层面的方案 (月球探测等危险场景、医疗外 (脑机融合等) 科精细手术等)、智能决策系统 (股票交易系统等) 机器智能难以模拟人类人机混合增强智能,“人 “人在环路”混合增强智能,242可 可扩展的 高级认知能力,机器智 在环路”AI系统及交互设 利用人与机器智能的优势互补. AL,高效 能技术发展的瓶颈效 计,人机协同控制,脑机 处理大规模、不完整和非结构化 强大的AI 应,孤立地开发机器智 混合系统,基于认知心理 知识信息:用户与AI系统交互中 人类可控的 能的发展途径缺乏可持 学研究的认知计算(情 不断知识迭代和学习,加深对数 AL,人拥有 人机混增强合 续性,AI开发中缺乏对 感、意图等).人类高级认 据及系统理解,AI模型接受特定 最终决控权 智能 人类控制和安全性的充 知能力模型、知识表征和输入并根据用户反馈信息确定 分考虑 图谱,人机共生与融合 输出,达到优于各自单独实现的 结果,避免AI技术带来的失控风 险,已应用在自动驾驶、辅助医 疗、视频检索等领域 缺乏成熟的人一AI合作 人-AI合作理论和模型, 从多学科角度出发,从感知、认 有用的AI. 理论、方法、认知架构。 人-AI合作团队绩效评估 知、执行层面上为基于人-AI合 可用的AL 缺乏成熟的人机态势感 和测试方法,人机共驾, 作的AI解决方案提供依据。例 人类可控 知共享、人机共信、人 社会环境中的人-AI合 如,人-AI合作研究策略和框架2阿 的AI 人-AI合作 机心理模型共享、人机 作,人-AI合作的人机交 人-AI合作团队绩效评估P7,人- 决策共享的理论、模型 互模型,人作为最终决策 AI互信2阁,人-AI合作中的心理 和方法 者的人-AI合作设计 模型四,人-A哈作的系统设计0, 人-AI哈作系统权限B,人- A1合作的定量和定性建模B

表 2 HAII 领域中实现 HCAI 理念所面临的挑战、HAII 可能解决方案、应用实例以及 HCAI 设计目标 Table 2 Challenges in realizing the HCAI design philosophy, possible HAII solutions, application examples, and expected HCAI design goals HAII领域重点 实现HCAI理 念面临的挑战 基于HCAI理念的 HAII可能解决方案 HAII领域研究和 应用实例 基于HCAI理念 的设计目标 (图1) AI系统的机器 行为 潜在的、带偏见的系统 输出,意外的机器行为, 独特的机器行为演变, 不成熟的机器学习训练 和测试方法,缺乏用户 参与的机器学习,社会 交互中的复杂机器行 为,多重AI代理之间的 复杂行为和交互 “以人为中心”机器学习, 交互式机器学习,人机交 互方法在数据收集、培 训、算法调整、测试中的 应用,基于行为科学方法 的机器行为研究 交互式机器学习: [22]基于“以人为 中心”理念,由目标用户(领域专 家)直接参与,降低对机器学习 专家的依赖,通过有效人机交互 来构建和训练机器学习模型。 用户检查、训练模型结果,不断 调整后续输入直到获得满意结 果。相对于传统机器学习,该方 法更加快速、高效和优化,已应 用在推荐系统、信息检索、情景 感知等领域 有用的AI, 伦理化AI, 有责任AI 人类智能增强 人类智能增强技术 (IA)与AI技术之间的竞 争,IA和AI技术之间缺 乏优势互补的最佳方案 HAII可发挥IA和AI间的 桥梁作用,制定两种技术 的最佳组合方案,确保 AI技术增强人类智能,保 证人拥有最终控制权,开 发生物神经层面的方案 (脑机融合等) 整合IA和AI技术的智能系统,在 应用中增强人类智能,人类通过 监控(远程等)实现人机协同合作 以及保证人的决控权[23]。例如, 智能无人机(军用类等)、机器人 (月球探测等危险场景、医疗外 科精细手术等)、智能决策系统 (股票交易系统等) 有用的AI, 可用的AI, 增强人的能 力,人拥有 最终决控权 人机混增强合 智能 机器智能难以模拟人类 高级认知能力,机器智 能技术发展的瓶颈效 应,孤立地开发机器智 能的发展途径缺乏可持 续性,AI开发中缺乏对 人类控制和安全性的充 分考虑 人机混合增强智能,“人 在环路”AI系统及交互设 计,人机协同控制,脑机 混合系统,基于认知心理 学研究的认知计算(情 感、意图等),人类高级认 知能力模型、知识表征和 图谱,人机共生与融合 “人在环路”混合增强智能[1, 24-25] : 利用人与机器智能的优势互补, 处理大规模、不完整和非结构化 知识信息;用户与AI系统交互中 不断知识迭代和学习,加深对数 据及系统理解,AI模型接受特定 输入并根据用户反馈信息确定 输出,达到优于各自单独实现的 结果,避免AI技术带来的失控风 险,已应用在自动驾驶、辅助医 疗、视频检索等领域 可扩展的 AI,高效 强大的AI, 人类可控的 AI,人拥有 最终决控权 人−AI合作 缺乏成熟的人−AI合作 理论、方法、认知架构, 缺乏成熟的人机态势感 知共享、人机共信、人 机心理模型共享、人机 决策共享的理论、模型 和方法 人−AI合作理论和模型, 人−AI合作团队绩效评估 和测试方法,人机共驾, 社会环境中的人−AI合 作,人−AI合作的人机交 互模型,人作为最终决策 者的人−AI合作设计 从多学科角度出发,从感知、认 知、执行层面上为基于人−AI合 作的AI解决方案提供依据。例 如,人−AI合作研究策略和框架[26] , 人−AI合作团队绩效评估[27] ,人− AI互信[28] ,人−AI合作中的心理 模型[29] ,人−AI合作的系统设计[30] , 人−AI合作系统权限[31] ,人− AI合作的定量和定性建模[32] 有用的AI, 可用的AI, 人类可控 的AI ·610· 智 能 系 统 学 报 第 16 卷

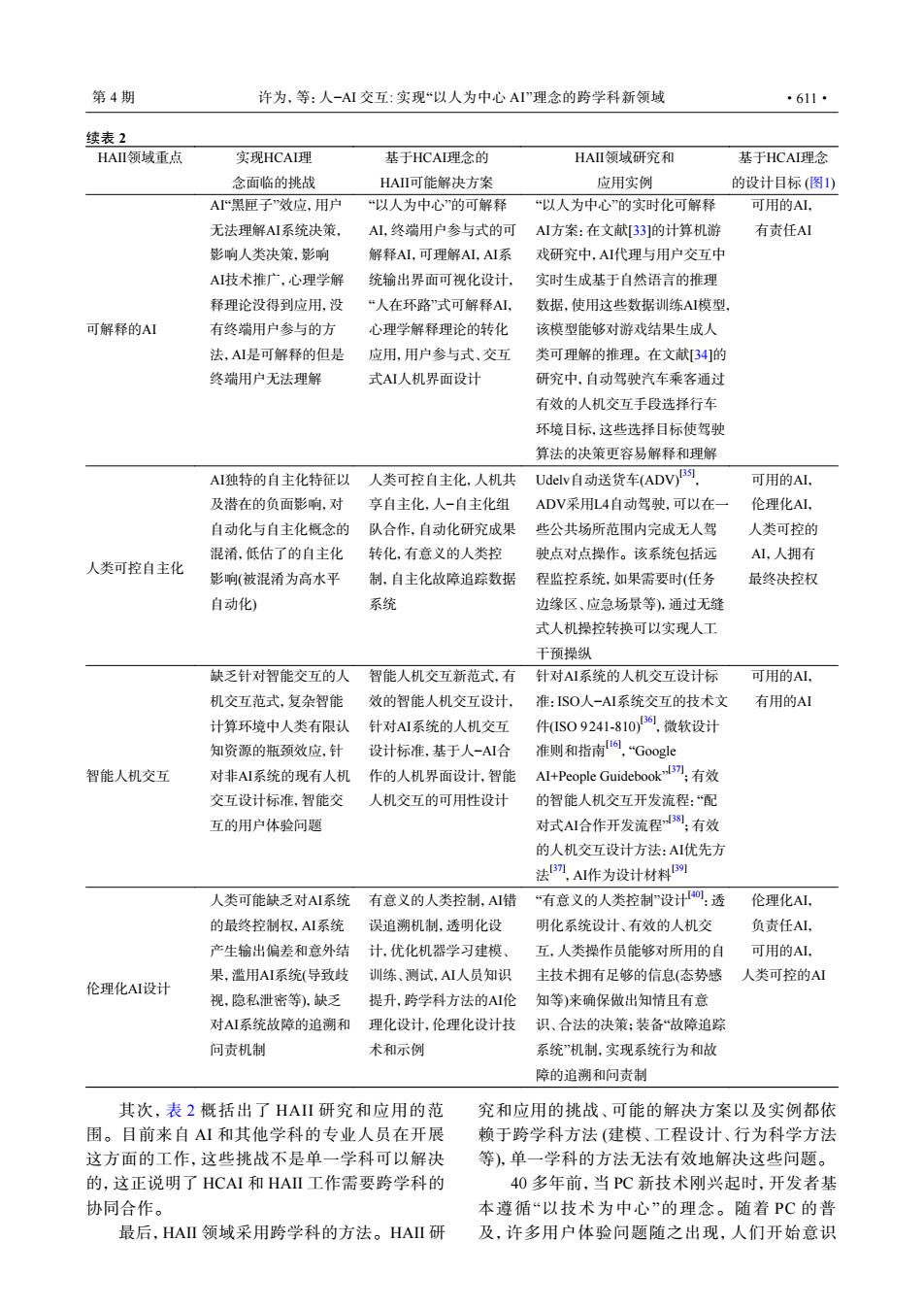

第4期 许为,等:人-AI交互:实现“以人为中心A”理念的跨学科新领域 ·611· 续表2 HAⅡ领域重点 实现HCAI理 基于HCA理念的 HAⅡ领域研究和 基于HCAI理念 念面临的挑战 HAII可能解决方案 应用实例 的设计目标(图) A黑匣子”效应,用户 “以人为中心”的可解释 “以人为中心”的实时化可解释 可用的AI. 无法理解AI系统决策, AL,终端用户参与式的可 AI方案:在文献33]的计算机游 有责任AI 影响人类决策,影响 解释AL,可理解AL,AI系 戏研究中,AI代理与用户交互中 AI技术推广,心理学解 统输出界面可视化设计, 实时生成基于自然语言的推理 释理论没得到应用,没 “人在环路”式可解释AL, 数据,使用这些数据训练AI模型, 可解释的AI 有终端用户参与的方 心理学解释理论的转化 该模型能够对游戏结果生成人 法,AI是可解释的但是 应用,用户参与式、交互 类可理解的推理。在文献[34]的 终端用户无法理解 式AI人机界面设计 研究中,自动驾驶汽车乘客通过 有效的人机交互手段选择行车 环境目标,这些选择目标使驾驶 算法的决策更容易解释和理解 AI独特的自主化特征以 人类可控自主化,人机共 Udelv自动送货车(ADVB阿 可用的AI, 及潜在的负面影响,对 享自主化.人一自主化组 ADV采用L4自动驾驶,可以在一 伦理化AL, 自动化与自主化概念的队合作,自动化研究成果 些公共场所范围内完成无人驾 人类可控的 混淆,低估了的自主化 转化,有意义的人类控 驶点对点操作。该系统包括远 AL,人拥有 人类可控自主化 影响(被混淆为高水平 制,自主化故障追踪数据 程监控系统,如果需要时(任务 最终决控权 自动化) 系统 边缘区、应急场景等),通过无缝 式人机操控转换可以实现人工 干预操纵 缺乏针对智能交互的人 智能人机交互新范式,有 针对AI系统的人机交互设计标 可用的AL. 机交互范式,复杂智能 效的智能人机交互设计, 准:ISO人-AI系统交互的技术文 有用的AI 计算环境中人类有限认针对AI系统的人机交互 件1S09241-810)36,微软设计 知资源的瓶颈效应,针 设计标准,基于人-AI合 准则和指南1.“Google 智能人机交互 对非AI系统的现有人机作的人机界面设计,智能 AI+-Peop Guidebook7:有效 交互设计标准,智能交 人机交互的可用性设计 的智能人机交互开发流程:“配 互的用户体验问题 对式AI合作开发流程;有效 的人机交互设计方法:AI优先方 法可,A作为设计材料网 人类可能缺乏对AI系统有意义的人类控制,AI错“有意义的人类控制"设计O:透 伦理化AI. 的最终控制权,AI系统 误追溯机制,透明化设 明化系统设计、有效的人机交 负责任AL, 产生输出偏差和意外结计.优化机器学习建模、 互,人类操作员能够对所用的自 可用的AI. 果,滥用AI系统(导致歧 训练、测试,AI人员知识 主技术拥有足够的信息(态势感 人类可控的AI 伦理化AI设计 视,隐私泄密等)缺乏 提升,跨学科方法的AI伦知等)来确保做出知情且有意 对AI系统故障的追溯和 理化设计,伦理化设计技 识、合法的决策:装备“故障追踪 问责机制 术和示例 系统”机制,实现系统行为和故 障的追溯和问责制 其次,表2概括出了HAⅡ研究和应用的范 究和应用的挑战、可能的解决方案以及实例都依 围。目前来自AI和其他学科的专业人员在开展 赖于跨学科方法(建模、工程设计、行为科学方法 这方面的工作,这些挑战不是单一学科可以解决 等),单一学科的方法无法有效地解决这些问题。 的,这正说明了HCAI和HAⅡ工作需要跨学科的 40多年前,当PC新技术刚兴起时,开发者基 协同合作。 本遵循“以技术为中心”的理念。随着PC的普 最后,HAI领域采用跨学科的方法。HA研 及,许多用户体验问题随之出现,人们开始意识

其次,表 2 概括出了 HAII 研究和应用的范 围。目前来自 AI 和其他学科的专业人员在开展 这方面的工作,这些挑战不是单一学科可以解决 的,这正说明了 HCAI 和 HAII 工作需要跨学科的 协同合作。 最后,HAII 领域采用跨学科的方法。HAII 研 究和应用的挑战、可能的解决方案以及实例都依 赖于跨学科方法 (建模、工程设计、行为科学方法 等),单一学科的方法无法有效地解决这些问题。 40 多年前,当 PC 新技术刚兴起时,开发者基 本遵循“以技术为中心”的理念。随着 PC 的普 及,许多用户体验问题随之出现,人们开始意识 续表 2 HAII领域重点 实现HCAI理 念面临的挑战 基于HCAI理念的 HAII可能解决方案 HAII领域研究和 应用实例 基于HCAI理念 的设计目标 (图1) 可解释的AI AI“黑匣子”效应,用户 无法理解AI系统决策, 影响人类决策,影响 AI技术推广,心理学解 释理论没得到应用,没 有终端用户参与的方 法,AI是可解释的但是 终端用户无法理解 “以人为中心”的可解释 AI,终端用户参与式的可 解释AI,可理解AI,AI系 统输出界面可视化设计, “人在环路”式可解释AI, 心理学解释理论的转化 应用,用户参与式、交互 式AI人机界面设计 “以人为中心”的实时化可解释 AI方案:在文献[33]的计算机游 戏研究中,AI代理与用户交互中 实时生成基于自然语言的推理 数据,使用这些数据训练AI模型, 该模型能够对游戏结果生成人 类可理解的推理。在文献[34]的 研究中,自动驾驶汽车乘客通过 有效的人机交互手段选择行车 环境目标,这些选择目标使驾驶 算法的决策更容易解释和理解 可用的AI, 有责任AI 人类可控自主化 AI独特的自主化特征以 及潜在的负面影响,对 自动化与自主化概念的 混淆,低估了的自主化 影响(被混淆为高水平 自动化) 人类可控自主化,人机共 享自主化,人−自主化组 队合作,自动化研究成果 转化,有意义的人类控 制,自主化故障追踪数据 系统 Udelv自动送货车(ADV)[35] , ADV采用L4自动驾驶,可以在一 些公共场所范围内完成无人驾 驶点对点操作。该系统包括远 程监控系统,如果需要时(任务 边缘区、应急场景等),通过无缝 式人机操控转换可以实现人工 干预操纵 可用的AI, 伦理化AI, 人类可控的 AI,人拥有 最终决控权 智能人机交互 缺乏针对智能交互的人 机交互范式,复杂智能 计算环境中人类有限认 知资源的瓶颈效应,针 对非AI系统的现有人机 交互设计标准,智能交 互的用户体验问题 智能人机交互新范式,有 效的智能人机交互设计, 针对AI系统的人机交互 设计标准,基于人−AI合 作的人机界面设计,智能 人机交互的可用性设计 针对AI系统的人机交互设计标 准:ISO人−AI系统交互的技术文 件(ISO 9 241-810)[36] ,微软设计 准则和指南[16] ,“Google AI+People Guidebook”[37] ;有效 的智能人机交互开发流程:“配 对式AI合作开发流程” [38] ;有效 的人机交互设计方法:AI优先方 法 [37] ,AI作为设计材料[39] 可用的AI, 有用的AI 伦理化AI设计 人类可能缺乏对AI系统 的最终控制权,AI系统 产生输出偏差和意外结 果,滥用AI系统(导致歧 视,隐私泄密等),缺乏 对AI系统故障的追溯和 问责机制 有意义的人类控制,AI错 误追溯机制,透明化设 计,优化机器学习建模、 训练、测试,AI人员知识 提升,跨学科方法的AI伦 理化设计,伦理化设计技 术和示例 “有意义的人类控制”设计[40] :透 明化系统设计、有效的人机交 互,人类操作员能够对所用的自 主技术拥有足够的信息(态势感 知等)来确保做出知情且有意 识、合法的决策;装备“故障追踪 系统”机制,实现系统行为和故 障的追溯和问责制 伦理化AI, 负责任AI, 可用的AI, 人类可控的AI 第 4 期 许为,等:人−AI 交互: 实现“以人为中心 AI”理念的跨学科新领域 ·611·