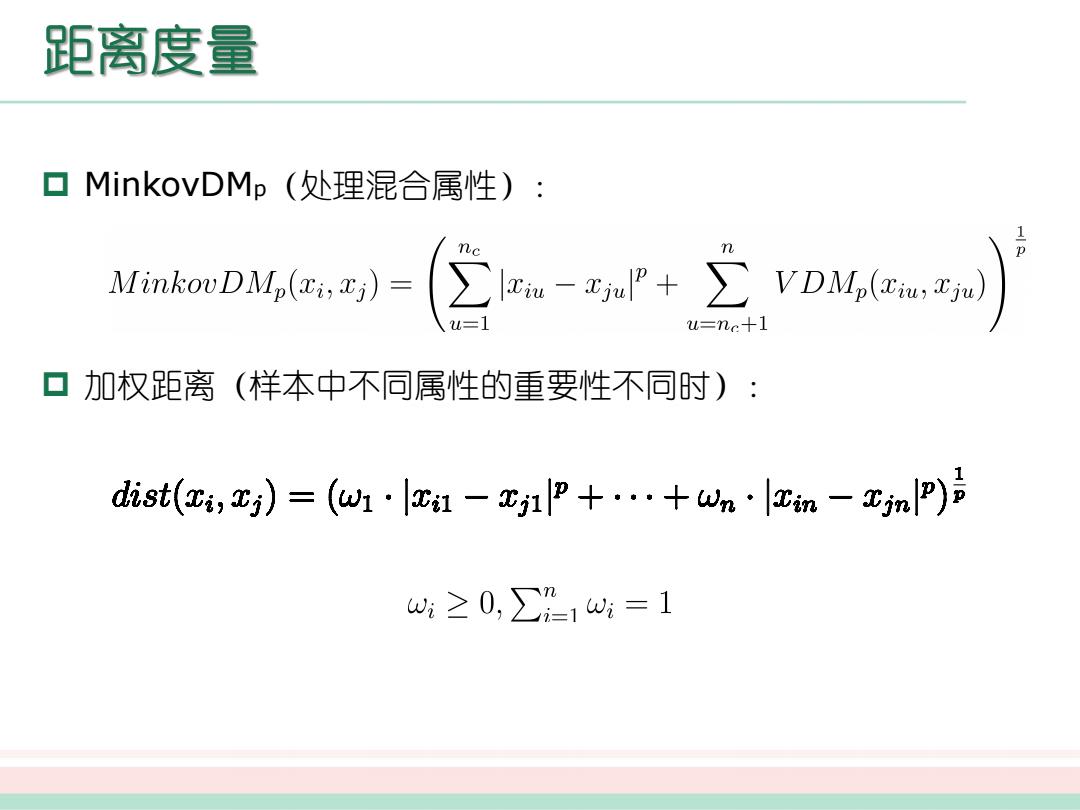

距离度量 ▣MinkovDMp(处理混合属性): nc MinkouDMp(Ji,xj)= u三1 -w u=nc+】 ▣加权距离 (样本中不同属性的重要性不同时): dist(,g)=(w1·lr1-1P+…+wn·l3m-xn|P) w≥0,∑%1w5=1

p MinkovDMp(处理混合属性): p 加权距离(样本中不同属性的重要性不同时):

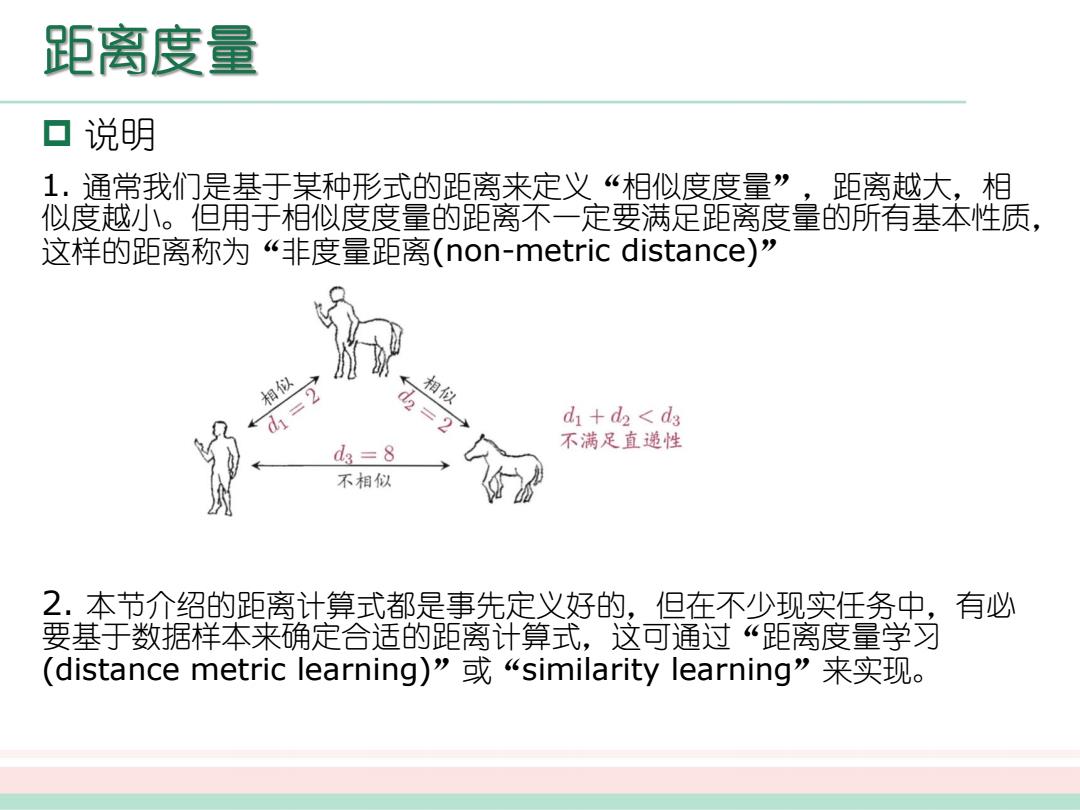

距离度量 口说明 1.通常我们是基于某种形式的距离来定义“相似度度量”,距离越大,相 似度越小。但用于相似度度量的距离不一定要满足距离度量的所有基本性质, 这样的距离称为“非度量距离(non-metric distance)” 相似 相似 d d2=2 d+d<d3 不满足直递性 d3=8 不相似 2.本节介绍的距离计算式都是事先定义好的,但在不少现实任务中, 有必 要基于数据样本来确定合适的距离计算式,这可通过“距离度量学习 (distance metric learning)”或“similarity learning”来实现

p 说明 1. 通常我们是基于某种形式的距离来定义“相似度度量” ,距离越大,相 似度越小。但用于相似度度量的距离不一定要满足距离度量的所有基本性质, 这样的距离称为“非度量距离(non-metric distance)” 2. 本节介绍的距离计算式都是事先定义好的,但在不少现实任务中,有必 要基于数据样本来确定合适的距离计算式,这可通过“距离度量学习 (distance metric learning)”或“similarity learning”来实现

目录 口无监督学习任务 口基于原型的学习方法 ▣ EM算法 口动态聚类方法 口新方法

p 无监督学习任务 p 基于原型的学习方法 p EM算法 p 动态聚类方法 p 新方法

原型聚类 口原型聚类 也称为“基于原型的聚类”(prototype-based clustering),此 类算法假设聚类结构能通过一组原型刻画。 口算法过程 通常情况下,算法先对原型进行初始化,再对原型进行迭代更新 求解。采用不同的原型表示,将产生不同的算法

p 原型聚类 也称为“基于原型的聚类” (prototype-based clustering),此 类算法假设聚类结构能通过一组原型刻画。 p 算法过程: 通常情况下,算法先对原型进行初始化,再对原型进行迭代更新 求解。采用不同的原型表示,将产生不同的算法

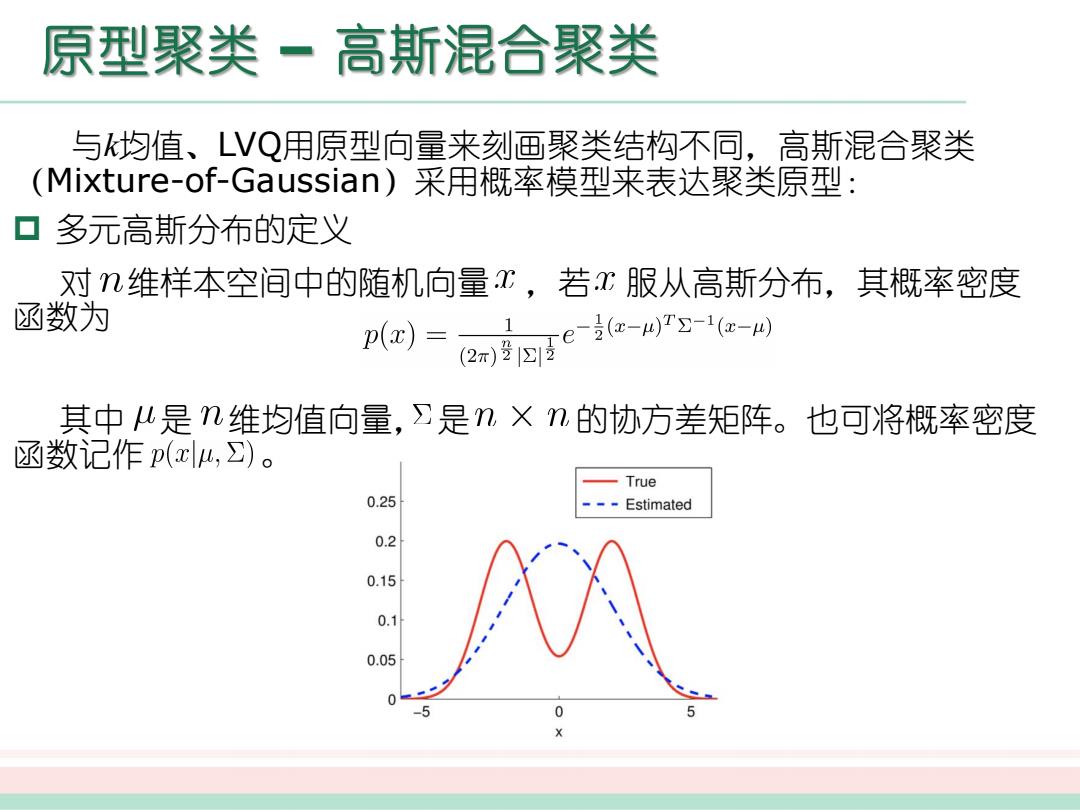

原型聚类一高斯混合聚类 与均值、LQ用原型向量来刻画聚类结构不同,高斯混合聚类 (Mixture-of-Gaussian)采用概率模型来表达聚类原型: ▣多元高斯分布的定义 对维样本空间中的随机向量:,若x服从高斯分布,其概率密度 函数为 p(x)= 1 e(e-)T-1(c-w) (2x)登1四 其中儿是n维均值向量,∑是n×n的协方差矩阵。也可将概率密度 函数记作p(xu,)。 -True 0.25 ---Estimated 0.2 0.15 0.1 0.05 0 X

与k均值、LVQ用原型向量来刻画聚类结构不同,高斯混合聚类 (Mixture-of-Gaussian)采用概率模型来表达聚类原型: p 多元高斯分布的定义 对 维样本空间中的随机向量 ,若 服从高斯分布,其概率密度 函数为 其中 是 维均值向量, 是 的协方差矩阵。也可将概率密度 函数记作